Geschäftsprozessmanagement in KMU Problemstellungen und Lösungsansätze

Interdisziplinäres Arbeiten in der Mensch-Computer Interaktion · 2014. 4. 8. · Global Public...

Transcript of Interdisziplinäres Arbeiten in der Mensch-Computer Interaktion · 2014. 4. 8. · Global Public...

Einführung und Motivation Wissenschaftliches Arbeiten ist ein systematischer

Wissensfindungsprozess und wird in „Gesetzen“ und „Theorien“ durch Beobachtung, Experiment, Messung, Mathematik, usw. beschrieben, um

intersubjektiv

trans-kulturell und

wiederholbar zu sein.

In der Ingenieurstätigkeit (Engineering) wollen wir die Dinge/Umwelt/… ändern und verwenden Design- und Entwicklungsmethoden, konzeptionelle Architekturen und formale Modelle um eine brauchbare Anwendung zu erhalten

Mensch-Computer Interaktion verwendet häufig das User Interface Engineering um die Usability (Gebrauchstauglichkeit) zu fördern

1

Dem Ingenieur ist nichts zu schwer,

Er türmt die Böschung in die Luft,

Er wühlt als Maulwurf in der Gruft,

Kein Hindernis ist zu groß,

Er geht drauf los.

Heinrich Seidel (1842 - 1906)

User Interface Engineering

2

Benutzeranalyse

Design

Implementierung

Evaluation

Aufgaben- und Kontextanalyse

Validierung und Evaluation Ihre Anwendungen werden von Benutzern (Kunden)

verwendet, dafür verwenden Ingenieure und Wissenschaftler mehrere Methoden

Validierung: der Prozess der Überprüfung in welchem Umfang ein System dessen Spezifikation erfüllt

Verifikation: ist ein Qualitätssicherungsprozess, um festzustellen ob ein System offiziellen Verordnungen, gesetzlichen Vorgaben, Standards und Normen erfüllt

Evaluation: ist eine systematische Bewertung eines Systems gegenüber bestimmten Kriterien bei Einhaltung einer Anzahl von Standards

Experimentelle Überprüfung: testen eines Systems bezüglich einer Hypothese (z.B. „Benutzer sind mit System A bei Aufgabe X schneller als in System B“) entweder im Labor, oder besser, im Feld

3

Geschäftsszenario

4

Neben dem wissenschaftlichen Beitrag und der Ingenieursleistung einer Arbeit sollte ein Geschäftsszenario adressiert werden

Das IT Beispiel: ein möglicher Kunde wird weniger Zeit aufwenden, um einen Arbeitsablauf zu erledigen und damit Arbeitszeit (=Kosten) sparen

aber in der Wissensgesellschaft sollte man auch andere Kriterien beachten: Qualität

Sicherheit

Verlässlichkeit

Barrierefreiheit

Literatur und Abkürzungen

5

Holzinger, Andreas: Process Guide for Students for

Interdisciplinary work in Computer

Science/Informatics. Books on Demand

(www.bod.de), 128 S., ca.12€

Überblick, Themenfindung,

Literatursuche, Zitierhinweise,

Versuchsaufbau,

Vortragsgestaltung,

Fördermöglichkeiten und Antragsschreibung

LV = Lehrveranstaltung

Organisatorisches

6

Erstkontakt Sprechen Sie mit dem Betreuer nach der Vorlesung, senden eine E-Mail

an Mitarbeiter der Professur (Themen im WWW) oder rufen wegen eines Gesprächs an ([email protected])

Arten von Arbeiten Hausaufgaben in Übungen zu LV (ca.4-7 Aufgaben/Semester)

Korrektur über Moodle

Bachelorarbeit (6.Sem.) Zwischenpräsentation, Verteidigung

Masterpraktikum (Komplexpraktikum MBO)

Masterarbeit (4.Sem.) Zwischenpräsentation, Verteidigung

Doktorarbeit (3-5 Jahre)

Habilitation

Externe Arbeiten (Thesis) Sperrvermerk klären

Thesis/Abschlußarbeit zum Literaturserver der SLUB www.qucosa.de hochladen für Archivierung

Professuren im Bereich MCI

7

Mensch-Computer Interaktion

Prof. Weber - IAI

• Informatik - AI

Prozessleit-technik

Prof. Urbas (ET)

Ingenieur-psychologie und

Kognitive Ergonomie

Prof. Panasch (Psychologie)

Software Engineering ubiquitärer Systeme

Jun.Prof. Schlegel

(SWT)

Multimediatechnik

Prof.Dachselt- SWT

Themen finden

8

Sie sollten in einem Thema gut sein!

Wie findet man ein Thema? Aktives Lesen von Konferenzbeiträgen: Outlook, future directions, was

würden Sie tun?

Aktives Fragen: Teilnahme an relevanten LV und Verstehen

Blooms 6 Ebenen des Verständnis Wissen: erinnern, erkennen, abrufen, identifzieren, definieren, …

Was war die Kernfrage der Forschung?

Verstehen: interpretieren, beschrieben, erklären, bewerten, … Können Sie das Experiment bitte genauer beschreiben?

Anwendung: Probleme lösen … Wie wurde Methode X für Ergebnis Y angewendet?

Analyse: zerlegen und zusammensetzen … Welchen Vorteil hat Ihre Lösung gegenüber dem Beitrag von Y?

Synthese: eine neue, originäre, einzigartige Idee erstellen … Welche Lösung schlagen Sie vor, um Problem Y zu lösen?

Evaluation: auflösen von Widersprüchen und entwickeln von Entscheidungen … Welche Kriterien sind mit Ihrer Lösung im Bereich X anwendbar ?

Weitere Strategien für Themensuche

9

Fahnden

Webseiten der Professuren, Veröffentlichungen in Journals, Patente auswerten

Nicht suchen – anfangen

Manchmal ist es besser nicht auf das perfekte Thema zu hoffen und dafür sich mit

einem Problem auseinander zu setzen und es durchzuziehen

Machbarkeit

Kann ich das? Komme ich an alles heran was notwendig ist?

SWOT-Analyse

Themencluster MCI

Anwendungsgebiet

Menschen

Kontext und Prozesse

Geräte und Maschinen

Interaktion und Modalität

Innovation

Past&

Present

Future

Positive Strength Opportunities

Negative Weakness Threats

Themencluster meiner LV

10

Mensch-

Comput-er

Inter-aktion

MCI (2+2)

Interaktive

Systeme

EAI (1+1)

Multi-

modale

Ben. o.

MBO (2+2)

Barriere-

freie Doku-

mente BFD

(2+2)

Komplex-

prakti-kum

(6)

Haupt-

seminar (2)

Anwendung

en

Web, Mobil

Java

Java,

Android

Telefon,

Android,

C#

Web

JavaScript

Desktop,

Tabletop,

Handy

diverse

Menschen Task,Stereot

ypen

Kognition

Persona

Haptische

Usability

Behinderte

&Senioren

z.B.

Theaterbasi

erte Eval.

Kontext UCDesign,

Adaptivität

Design Kontext-

wechsel

TUD,

AG SBS

diverse

Geräte Schichten-

modell

Handy

(Android)

Video, Kraft,

Sprache

Assistive

Technologie

diverse

Interaktion Fitt‘s Law,

GUI, Zeit

SWT, GPS Gesten

SMIL, SAPI

AJAX z.B. Brain-

Computing

Innovation Evaluations

methoden

Mobile

Evaluations

methoden

EMMA

HMM

bf Grafik,

Gebärden-

sprache

Förder-

projekte

Neue

Themen

Themenbeispiele

11

Interdisziplinäre Arbeiten der Professur MCI

12

Gestenerkennung Navigationssystem:

Informatik und

Elektrotechnik/Infor-

mationstechnik

Braille Lesetest:

Informatik und

Erziehungs-

wissenschaften

Anwendunge

n

Texteingabe,

Skizzieren

Sonderziele finden Texte lesen

Menschen Nomaden Autofahrer blinde Menschen

Kontext Wohnzimmer und

passive

Verkehrsteilnehmer

Kfz Arbeitsplatz

Geräte Tablet Lenkrad,

Spracheingabe

Stiftplatte

Interaktion Gesten Listen Lesen

Innovation Gestenform selbst

festlegen

Mehrdeutige

Suchanfragen

flächige Anzeige

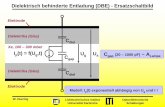

Template-basierte Gestenerkennung

13

Problem: Wie können Gesten ohne

aufwändiges Training erkannt

werden?

strukturelle und

dynamische Merkmale berücksichtigen

Multitouch und Multistroke

Methode:

Bayesscher Entscheidungsprozess

Maximum likelihood Auswahl

[Schmidt, 2013]

Mobile MCI: Sonderzielsuche im Kfz

14

Problem: Wie sollen Sonderziele

dargestellt werden? [DA Kuznetsova,

2010]

Fragebogen zur Verwendung von

Navigationsgeräten für die Suche nach

Sonderzielen: Attribute&Reihenfolge

Designvorschläge entwickeln

Fahrfehler bestimmen (n= 16)

Fragebogen: Verwendung von

Navigation und POI-Suche

Statistik

Altersgruppe <20 20-30 30-40

40-50 >50

Wenn Sie nach POI’s suchen, wo

suchen Sie diese am häufigsten?

(Mehrfachnennung möglich)

o POIs in der Nähe (der aktuellen Position)

o POIs in einer bestimmten Stadt

o POIs in der Nähe Ihrer Heimatadresse

o POIs in der Nähe des eingegebenen

Zielpunkts

o POIs entlang der Route

o POIs landesweit (z.B. in ganz Deutschland)

Braille lesen

15

Problem: verlangsamen

äquidistante Braillepunkte

einer (3,5)-Matrix den

Leser?

4 verschiedene

Lesematerialien, 5 min

laut vorlesen, Anzahl der

Worte, bestimmen, 20

Teilnehmer, zufällige

Auswahl des Lesestoffs, 8

Punktschrift

Leseform Mittelwert Varianz

Papier 58,9 WpM 16,3

40er Braillezeile 50,0 WpM 12,8

Stiftplatte 45,2 WpM 14,0

40er Zeile in

Stiftplatte

41,2 WpM 10,9

Forschungsprojekte

Cloud4All, Mobility

Tangram, Range-IT

16

Projekt Cloud4All

17

Personalisierung der Barrierefreiheit

Global Public Inclusive Infrastructure GPII (Video)

Adaptierbarkeit durch behinderte Menschen

Problemstellungen:

Kann man Adaptivität für Behinderungen realisieren?

Was sind geeignete Benutzerprofile und barrierefreie Interaktion zur Adaptierung?

TUD: Matchmaking zwischen Präferenzen und Einstellungen mittels regel-basierten Verfahren für

Kiosk

Settop-Box (TV)

Firefox

Mobiltelefon

Methode: Ontologie der Assistiven Technologien heranziehen

Projekt MOBILITY

18

Verbesserung der Mobilität in großen Umsteigegebäuden: Flughafen Frankfurt

Problemstellung: Wird die Selbständigkeit blinder Menschen durch mobile, ostbezogene akustische Information verbessert? mentales Modell für Räume

erlaubt Sonifikation die „Taschenlampe für Blinde“?

TUD: Android-Client für Hörbuch mit Indoor-Georeferenzen

Methode: W-LAN Triangulation, Evaluation der Entscheidungen und Informationsgestaltung (Route vs. Überblick)

Projekt TANGRAM

19

Barrierefreie Bilder bei der

Fachbucherstellung

Hintergrund: WCAG 2.0

fordert verbale

Bildbeschreibungen

Problemstellung:

Erstellung von

Bildbeschreibungen

automatisieren

prüfen durch blinde

Menschen (zeichnen) und

autom. anhand von

Prüfkriterien

insbesondere für

graphische Notationen

Projekt Range-IT

20

Weiterentwicklung einer 3D Kamera für

Hinderniserkennung mit haptischem

Feedback

Problemstellung: Bildverarbeitung,

Bestimmung der Eigenbewegung und

Dialogmanagement

Methode: Fusion von Sensordaten,

Kartenerstellung für Raumerschliessung

Mensch-Computer Interaktion

Dipl. Inf. Michael Schmidt

Projekt HyperBraille

Planare Gesten

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 22

Motivation

WHO Schätzung (2002):

• weltweit ~37 Millionen Menschen blind (etwa 160.000 in Deutschland)

International Federation of Aging (2010)

• benennt direkte weltweite Kosten durch Verlust der Sehfähigkeit mit 2,4 Trillionen Dollar – Assistenzangebote, etc.; Selbständigkeit verringert Kosten

– Assistive Technologien steigern Produktivität im volkswirtschaftlichen Sinne doppelt

[IFA2013]

[WHO2002]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 23

Screenreader

• PC – Nutzung? Screenreader?? – Erkunden des Bildschirminhaltes

– Erstellen alternativer Repräsentationen

• Linearisiert, Alternativ-Beschreibungen für Grafik, Linklisten,…

– Synthetische Sprachausgabe (Beispiel mp3 60%)

– Ausgabe in Braille

Linux: Orca Windows:

SuperNova

[Orca] [JAWS] [Dolphin]

[EvenGrounds]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 24

Nochmal?

Ein Screenreader (von englisch screen reader ‚Bildschirmlese-programm‘), auch Vorlese-Anwendung genannt, ist eine Software, die Blinden und Sehbehinderten eine alternative Benutzerschnittstelle anstelle des Textmodus oder anstelle einer grafischen Benutzeroberfläche bietet. Ein Screenreader vermittelt die Informationen, die gewöhnlich auf dem Bildschirm ausgegeben werden, mithilfe nicht-visueller Ausgabegeräte. Die Bedienelemente und Texte werden dabei mittels Sprachsynthese akustisch zumeist über eine Soundkarte oder taktil über eine Braillezeile wiedergegeben.

[Wikipedia]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 25

Projektziel HyperBraille

• Entwicklung eines grafikfähigen Screenreaders für ein taktiles Flächendisplay

• Blinden Zugang bieten zu Windows-Desktop und –Anwendungen

• Ergänzung üblicher Screenreader, aber Subsummierung der Ein-und Ausgabegeräte (multimodale Ein-/Ausgabe)

• Möglichkeiten taktiler/akustischer Repräsentationen erforschen

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 26

HyperBraille

Projekt:

• Mitte 2007 – Ende 2010

• 10 Projektpartner (mehrere Universitäten,Firmen, Blindenstudienanstalt)

• Knüpft an vorangegangenes Projekt 02-06 an

• Grundsteine schon im Jahre 1985 gelegt

• Elektromagnetisch

angesteuerte Stiftplatte

• Fenstersystem mit Inhalt

aus Bildschirmtext (1987)

• später TAWIS

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 27

HyperBraille - Display

Berührungsempfindliches taktiles Display

BrailleDis 9000

• 7200 Pins verteilt auf 720 Module

• berührungsempfindliche Module mit je 2x5 Pins

• Zusätzliche Braille Tastatur zur Text-Eingabe

(bzw. als Modifikator- und Funktionstasten)

• Refresh-Rate 50ms

• Pin-Abstand 2,5mm

[Schiewe2009]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 28

HyperBraille - Module

konventionelle Module

neuartige vertikale Konstruktion

[Voelkel2008 ]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 29

Eigenheiten des Displays

Geringe Touch-Auflösung:

Probleme bei Cursor-

Routing

Äquidistante Stiftanordnung:

Lt. Tests unproblematisch

[Prescher2010a]

[Prescher2009]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 30

HyperBraille - Architektur

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 31

User Centered Design

Problem:

• Nutzer können wenig mit abstrakten Spezifikationen anfangen

• voll funktionsfähiges User Interface aber erst spät in der Entwicklung verfügbar

Prototypen erstellen

so früh wie möglich mit Nutzern testen

[Prescher2009]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 32

User Centered Design

Aber: Nicht Entwurf auf Nutzer abwälzen

Besser: Mock Ups, Wizard of Oz Tests

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 33

Mock Ups

• Tactile Paper Prototyping in sehr früher Phase

• Mock Up Entwürfe von blinden und

sehenden Nutzern entwickelt

Erkenntnisse:

Bereichskonzept, Arbeitsansicht,

anwendungsspezifische Gestaltungen

Darstellungsbereich

Kopfbereich

Detailbereich

Stru

ktu

rlei

ste

[Miao2009]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 34

Wizard-of-Oz Test

Testen geeigneter Repräsentationen und Interaktionstechniken

Fenster, Sichten, Verfeinerung des Bereichskonzepts, Minimap, Gestenbedienung

[Prescher2009]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 35

Wizard-of-Oz Tests - Resultate

[Prescher2009]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 36

Wizard-of-Oz Tests - Resultate

[Prescher2010b]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 37

Und die Hardware?

Nutzeranforderungen aus vorangehenden Kommentaren:

• Größerer Abstand zwischen Display und Tasten notwendig (häufige, nicht gewollte Betätigung der Tasten)

• Platte abschrägen wie ein Lesepult

• Tasten neben dem Display zur Navigation

• frei konfigurierbare Zusatztasten

• zusätzlicher TASO-Schieber

oder ähnlich Funktionales

Durchführung zweier Nutzertests (Ermittlung v. Anforderungen an Tasten + Gehäuse) mit Mock Ups und Wizard-of-Oz Methode (6 Probanden)

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 38

Wizard-of-Oz Test - Hardware

Vorgehen:

- Erläuterung Stiftplatte, HyperReader, Symbol- und Originalansicht, Funktion der Tasten sowie Gesten und deren Ausführung

- Thinking Aloud Methode Aufzeichnung, Protokolle

- Vornehmlich Aufgaben der Navigation und Orientierung unter Verwendung unterschiedlicher Eingabemöglichkeiten

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 39

Mock Up Test - Hardware

- Lesen, Bearbeiten und

Erstellen v. Text auf taktilen Ausdrucken

- Erkunden mittels Braille- und

Gesteneingabe, um Ergonomie der

Abläufe zu erfahren

- Befragung, Protokollierung, Thinking Aloud

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 40

Hardware Tests - Resultate

Gewünschte Änderungen Ergonomie

• Leichte Abschrägung der gesamten Stiftplatte (10° - 15°)

• Geringere Höhe der Stiftplatte

• Absenkung der Eingabetasten mit Hilfe einer abgeschrägten Tastenfläche

• Anschlag der Tasten verändern (Hub verringern, Anschlag deutlicher)

Weitere Resultate:

• Neupositionierung der Braille Tasten

• Cursorkreuz für Cursor-Routing + Feinjustierung

• statt TASO Schieber Navigationsleiste (unterhalb Lesefläche, leichter Absatz)

• Mausräder

• Eventuell Tastaturschlitten

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 41

Neugestaltung Hardware

[HyperBraille]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 42

Wizard-of-Oz Test – Gesten-Lernen

• Untersuchung der Möglichkeit, Gesten über taktile Darstellung allein (ohne Braille) zu erfassen

• Hand Detektion Furchen führen zu Ausgangsposition Linienmuster zeigen Gestenform

• Hilfestellung und Korrektur durch den Wizard

[Schmidt2009]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 43

• linguistische Sicht: • koverbale Bewegungen der Arme und Hände

• Ausklammerung von Zeichensprache

• MCI (implizit): • nichtmimische Bewegungen des Körpers zur

Informationsübertragung/Kommunikation

• aus System/Entwicklersicht verschiedenste aktivierende Technologien (Touchscreen/-Pad, Stylus, Kamera, Datenhandschuh)

• auch: Zeichensprache

[McNeill1992]

Gesten

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 44

Unterscheidung

• Planare Gesten (synthetisch) • deiktisch

• manipulativ

Nicht:

Direkte Manipulation

• symbolisch

[gesturelib]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 45

Planare Gesten

• Populär durch: • Jeff Han (2006): Videos\Jeff_Han_on_TED_Talks.mp4

• Apple iPhone (2007)

• MS Surface(2007) [Apple]

[MSDN]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 46

Wozu? - Anwendungen

• Zusätzliche/Alternative Modalität • Outdoor, Kiosk-Anwendungen

• Intuitive Interfaces (Browsergesten, Bildbetrachtung)

• Gaming, …

• Texteingabe

• Accessibility (GUI Bedienung)

• Sketching?

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 47

Gesten Alphabete

EdgeWrite MDITIM

Graffiti (Palm PDA)

Unistrokes (1993)

[Wobbrock2006]

[Isokoski2000]

[Castellucci2008]

[Koltringer2004]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 48

Multi-Touch Gesten Alphabet

• Texteingabe signifikant schneller

• Multi-Touch kann mehr Spaß machen

• große Varianz in bevorzugten Zeichen

• Individualisierung gewünscht

[Schmidt2013c]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 49

Accessibility

• Untersuchung: Nutzer definieren Gesten für vorgegebene Operationen

• Resultate: • Häufig andere Gesten als in aktuellen UI verwendet

• Gesten von Blinden und Sehenden unterscheiden sich

• (Blinde nutzen signifikant öfter multitouch, signifikant mehr strokes)

• Touchscreens + direkte Manipulation

kein taktiles Feedback (Ausschluss Blinde, stark Sehbehinderte)

teilweise selbst geschaffene Probleme

• Lösung: symbolische Gesten, „explore by touch“

[Kane2011]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 50

• Mp3-Player (PDA, Dell Axim x51v) • Schwellpapierauflage (taktile

Buttons) vs. Gesten (Flick + Tab) • Tab ungenau (Abstand Finger-

Screen schwer abschätzbar) • Gesten langsamer, ungenauer • Allerdings: Auflage nicht für alle

Touchscreens geeignet, für jedes Interface neu, nicht softwareseitig lösbar

• Audio Ausgabe + Gesten

• Scrollen (Listen Browsen)

• Auswahl (2. Finger)

• Blättern (nächster Song)

• Hierarchisches Browsen (Unterordner)

Accessibility

[McGookin2008] [Kane2008]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 51

Multi-Touch Sketching

[Schmidt2013b]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 52

Hardware

• Touchscreen Technologien • Resistiv

• Optisch

• Kapazitiv

• LED Matrix

• Lichtschranke

• Schall

• …

• Entwicklungen schon seit Mitte 1960er [Buxton2010a]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 53

Hardware - Resistiv

• Zwei leitfähige Schichten (ITO) • Trennung durch Isolierschicht • Controller steuert wechselseitigen Stromfluss an Schichten • Druck verbindet leitfähige Schichten gegenseitig messbarer Stromfluss (horizontale/vertikale Position) • geringe Kosten, unabhängig vom berührenden Objekt • Kratzanfällig, unklares Bild (Schutz beeinflusst Funktionalität)

[Schoening2008]

[Schoening2008]

[Downs2005]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 54

• IBM Simon (1993) – erstes „Smartphone“

• Nintendo DS (2004)

• Palm Pilot (erster PDA von Palm 1996)

Hardware - Resistiv

[Buxton2010a]

[Wikimedia]

[Nintendo]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 55

• Diffused Illumination

• einfach, kostengünstig (Beamer, Kamera) • Umrisserkennung

• Frustrated Total Internal Reflection

• Projektionsschicht nötig (Parallaxefehler) • Keine Umrisserkennung

Hardware - Optisch

Projektion des Bildes (z.B. Acrylplatte)

beliebige Kontakte

lichtempfindlich, groß

[Spath2010]

[Han2005]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 56

[Surface]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 57

• Surface Capacitive

• Ähnlich resistiv, aber empfindlicher • Leitende Beschichtung (ITO) auf Glas • Spannung an Ecken erzeugt

elektrisches Feld • Berührung: Entladung über Finger,

Strom messbar an Ecken • Sehr genau

• Projected Capacitive

• Spannung an Sendeantennen • Elektrisches Feld zw. Sende-,

Empfangsantennen • Näherung Kapazitätsänderung an

Kreuzungspunkten Spannung Empfangsantennen

• Kleines Bauvolumen • Keine Umrisserkennung möglich

Hardware - Kapazitiv

[Schoening2008] [Spath2010]

(single-touch) teuer hohe Klarheit verlässlich haltbar [Schoening2008]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 58

• Projected Capacitive – iPhone(2007)

• Hybrid (Capacitive + Inductive) – Induktiv: Induktionsstrom über

Spule in speziellen Stiften

– Samsung Galaxy Note

[Wikimedia]

[Wikimedia]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 59

[Sato2012]

Touché

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 60

• Bilder ausgeben, Lichtmessung im schnellen Wechsel • jede zweite LED sendet Licht Lichtreflexionsmessung (Photodiode) • beliebige Kontakte,

Entfernungsmessung • Keine Erkennung in dunklen

Bereichen

• Matrix Light emitter + optically isolated light detector

• Durchleuchten des LCD Panels

• Detektieren des reflektierten Lichts (durch z.B. Finger)

• MS Surface 2 basiert auf dieser Technik [Buxton2010]

Hardware - LED Matrix

[Hodges2007] [Spath2010]

Geringe Auflösung

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 61

[PixelSense]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 62

• Surface Acoustic Wave

• Ähnlich Infrarot Gitter • Piezoelektrische Signalgeber/-

Nehmer für x, y-Achse • gerichtete Ultraschallwellen

auf Glasoberfläche • Änderungen geben

Berührungsposition an

• Dual touch • Resistent Bankautomaten

• Mikrophon am Handgelenk Geräusche der Knochen • Anhand Spannungen direkt Gesten-Klassifikation ((double-)Tap, Rub, Flick)

Hardware - Schall

[Schoening2008] [Amento2002]

• Akkustisch „Knochenmikrofon“

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 63

Gesten - Klassifikation

?

?

[Schmidt2013a]

Modelle & Beschreibungssprachen Regel-basierte Klassifikation Statistische Klassifikation Optimal Margin Classifiers Neuronale Netze Nächste-Nachbar-Suche/ Templates/Wörterbuchsuche

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 64

Levenshtein Distanz

• Spezielle „edit distance“ Abstandsmaß für Strings/Zeichenketten

• Distanz ist Anzahl Elementaroperationen für die

Transformation eines Strings in einen anderen • Elementaroperation: Ersetzen, Einfügen, Löschen eines Buchstaben „Exhausted“ h=c, -a, -t 3 Operationen „Excused“

• Auch geeignet für Gestenerkennung (nominale Merkmale)

[Duda2001]

[Levenshtein1966]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 65

Levenshtein Distanz

• Symbolsequenzen? Quantisieren des Pfades

Winkel Positionen (Zoning)

[Kostakos2003] [Freitas2007] [Isokoski2000]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 66

Verfahren

• Gegeben: – Gesteneingabe, Folge von Punkten mit (x,y)-Koordinaten

– Gestentemplates als Symbolfolgen (Beispiel „1243“)

– „Schablone“ (z.B. 4 Zonen)

• 1. Vorverarbeitung – Schwerpunkt bestimmen:

Durchschnitt aller Punkte

– Spezialfall: degenerierte Bounding Boxen

• zu schmal nur 2 Zonen

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 67

Verfahren

• 2. Quantisierung der Eingabe – Für jeden Punkt in Eingabe Zone bestimmen

• Punkt oberhalb (1,2) oder unterhalb (3,4), links (1,3) oder rechts (2,4) von Schwerpunkt

– Ignorierung der Punkte in 0-Zone sorgt für

robustere Symbolsequenzen

• Abstand Punkt – Schwerpunkt prüfen

– gleiche aufeinanderfolgende Symbole

entfernen

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 68

Verfahren

• 3. Template Matching – Berechne Abstand der Symbolsequenz zu jedem Template

– Wähle als Ergebnis Template mit geringster Distanz

– Abstand? Levenshtein Distanz, Methode der dynamischen Programmierung

• Matrix c

• Zeichenkette X, Zeichenkette Y

jjjc

iiic

,],0[

,]0,[

]))[],[(1]1,1[,1]1,[,1],1[(],[ jYiXjicjicjicMinjic

Einfügen Löschen Austausch/keine Änderung

yx

yxyx

,0

,1),(

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 69

Levenshtein Distanz

• Initialisierung

jjjc

iiic

,],0[

,]0,[

e x h a u s t e d

0 1 2 3 4 5 6 7 8 9

e 1

x 2

c 3

u 4

s 5

e 6

d 7

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 70

Levenshtein Distanz

• Berechnung

]))[],[(1]1,1[,1]1,[,1],1[(],[ jYiXjicjicjicMinjic

yx

yxyx

,0

,1),(

e x h a u s t e d

0 1 2 3 4 5 6 7 8 9

e 1 0 1 2 3 4 5 6 7 8

x 2

c 3

u 4

s 5

e 6

d 7

Einfügen Löschen Austausch/keine Änderung

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 71

Levenshtein Distanz

• Berechnung

]))[],[(1]1,1[,1]1,[,1],1[(],[ jYiXjicjicjicMinjic

yx

yxyx

,0

,1),(

e x h a u s t e d

0 1 2 3 4 5 6 7 8 9

e 1 0 1 2 3 4 5 6 7 8

x 2 1 0 1 2 3 4 5 6 7

c 3 2 1 1 2 3 4 5 6 7

u 4 3 2 2 2 2 3 4 5 6

s 5 4 3 3 3 3 2 3 4 5

e 6 5 4 4 4 4 3 3 3 4

d 7 6 5 5 5 5 4 4 4 3

Einfügen Löschen Austausch/keine Änderung

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 72

Levenshtein Distanz

[Duda2001]

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 73

Quellen

• [Amento2002] Brian Amento, Will Hill, and Loren Terveen. The sound of one hand: a wrist-mounted bio-acoustic fingertip gesture interface. In CHI ’02 extended abstracts on Human factors in computing systems, CHI EA ’02, pages 724–725, New York, NY, USA, 2002.

• [Buxton2010] Bill Buxton. 31.1: Invited paper: A touching story: A personal perspective on the history of touch interfaces past and future. SID Symposium Digest of Technical Papers, 41(1):444–448, 2010.

• [Castellucci2008] Steven J. Castellucci and I. Scott MacKenzie. Graffiti vs. unistrokes: an empirical comparison. In Proceeding of the twenty-sixth annual SIGCHI conference on Human factors in computing systems, CHI ’08, pages 305–308, New York, NY, USA, 2008. ACM.

• [Dietz 2001] Paul Dietz and Darren Leigh. Diamondtouch: a multi-user touch technology. In Proceedings of the 14th annual ACM symposium on User interface software and technology, UIST ’01, pages 219–226, New York, NY, USA, 2001. ACM.

• [Downs2005] Rick Downs. Using resistive touch screens for human/machine interface. Technical report, 2005.

• [Duda2001] Richard O. Duda, Peter E. Hart, and David G. Stork. Pattern Classification. Wiley, New York, 2. edition, 2001.

• [Freitas2007] Cinthia O. de A. Freitas, Luiz S. Oliveira, Simone B. K. Aires, and Flávio Bortolozzi. Zoning and metaclasses for character recognition. In Proceedings of the 2007 ACM symposium on Applied computing, SAC ’07, pages 632–636, New York, NY, USA, 2007. ACM.

• [Fukunaga1990] Keinosuke Fukunaga. Introduction to statistical pattern recognition (2nd ed.). Academic Press Professional, Inc., San Diego, CA, USA, 1990.

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 74

Quellen

• [Han2005] Jefferson Y. Han. Low-cost multi-touch sensing through frustrated total internal reflection. In Proceedings of the 18th annual ACM symposium on User interface software and technology, UIST ’05, pages 115–118, New York, NY, USA, 2005. ACM.

• [Hodges2007] Steve Hodges, Shahram Izadi, Alex Butler, Alban Rrustemi, and Bill Buxton. Thinsight: versatile multi-touch sensing for thin form-factor displays. In Proceedings of the 20th annual ACM symposium on User interface software and technology, UIST ’07, pages 259–268, NY, USA, 2007. ACM.

• [Isokoski2000] Poika Isokoski and Roope Raisamo. Device independent text input: a rationale and an example. In Proceedings of the working conference on Advanced visual interfaces, AVI ’00, pages 76–83, New York, NY, USA, 2000. ACM.

• [Kane2008] Shaun K. Kane, Jeffrey P. Bigham, and Jacob O. Wobbrock. Slide rule: making mobile touch screens accessible to blind people using multi-touch interaction techniques. In Proceedings of the 10th international ACM SIGACCESS conference on Computers and accessibility, Assets ’08, pages 73–80, New York, NY, USA, 2008. ACM.

• [Kane2011] Shaun K. Kane, Jacob O. Wobbrock, and Richard E. Ladner. Usable gestures for blind people: understanding preference and performance. In Proceedings of the 2011 annual conference on Human factors in computing systems, CHI ’11, pages 413–422, NY, USA, 2011. ACM.

• [Költringer2004] Thomas Költringer and Thomas Grechenig. Comparing the immediate usability of graffiti 2 and virtual keyboard. In CHI ’04 extended abstracts on Human factors in computing systems, CHI EA ’04, pages 1175–1178, New York, NY, USA, 2004. ACM.

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 75

Quellen

• [Kostakos 2003] V Kostakos and E O’Neill. A directional stroke recognition technique for mobile interaction in a pervasive computing world. In People and Computers XVII, Proceedings of HCI 2003, pages 197—206, 2003.

• [Levenshtein1966] Vladimir I. Levenshtein. Binary codes capable of correcting deletions, insertions, and reversals. Technical Report 8, 1966.

• [McGookin2008] David McGookin, Stephen Brewster, and WeiWei Jiang. Investigating touchscreen accessibility for people with visual impairments. In Proceedings of the 5th Nordic conference on Human-computer interaction: building bridges, NordiCHI ’08, pages 298–307, New York, NY, USA, 2008. ACM.

• [Mcneill1992] David Mcneill. Hand and Mind: What Gestures Reveal about Thought. University Of Chicago Press, August 1992.

• [Miao2009] Mei Miao, Wiebke Köhlmann, Maria Schiewe, and Gerhard Weber. Tactile paper prototyping with blind subjects. In Proceedings of the 4th International Conference on Haptic and Audio Interaction Design, HAID ’09, pages 81–90, Berlin, Heidelberg, 2009. Springer-Verlag.

• [Prescher2009] D. Prescher. Ein taktiles Fenstersystem mit Multitouch-Bedienung ((a tactile window system with multitouch interaction). Diploma thesis, Institute of Applied Computer Science, TU Dresden, 2009.

• [Prescher2010a] Denise Prescher, Oliver Nadig, and Gerhard Weber. Reading braille and tactile ink-print on a planar tactile display. In Proceedings of the 12th international conference on Computers helping people with special needs, ICCHP’10, pages 482–489, Berlin, Heidelberg, 2010. Springer-Verlag.

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 76

Quellen

• [Prescher,2010b] Denise Prescher, Gerhard Weber, and Martin Spindler. A tactile windowing system for blind users. In Proceedings of the 12th international ACM SIGACCESS conference on Computers and accessibility, ASSETS ’10, pages 91–98, New York, NY, USA, 2010. ACM.

• [Sato 2012] Munehiko Sato, Ivan Poupyrev, and Chris Harrison. Touché: enhancing touch interaction on humans, screens, liquids, and everyday objects. In Proceedings of the SIGCHI Conference on Human Factors in Computing Systems, CHI ’12, pages 483–492, New York, NY, USA, 2012. ACM.

• [Schiewe2009] Maria Schiewe, Wiebke Köhlmann, Oliver Nadig, and Gerhard Weber. What you feel is what you get: Mapping guis on planar tactile displays. In Proceedings of the 5th International on ConferenceUniversal Access in Human-Computer Interaction. Part II: Intelligent and Ubiquitous Interaction Environments, UAHCI ’09, pages 564–573, Berlin, Heidelberg, 2009. Springer-Verlag.

• [Schmidt 2009] Michael Schmidt and Gerhard Weber. Multitouch Haptic Interaction. In UAHCI ’09: Proceedings of the 5th International on ConferenceUniversal Access in Human-Computer Interaction. Part II, pages 574–582, Berlin, Heidelberg, 2009. Springer-Verlag.

• [Schmidt2013a] Michael Schmidt and Gerhard Weber. Template based classification of multi-touch gestures. Pattern Recognition, 46(9):2487 – 2496, 2013.

• [Schmidt2013b] Michael Schmidt and Gerhard Weber. Recognition of multi-touch drawn sketches. In Masaaki Kurosu, editor, Human-Computer Interaction. Interaction Modalities and Techniques, volume 8007 of Lecture Notes in Computer Science, pages 479–490. Springer Berlin Heidelberg, 2013.

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 77

Quellen

• [Schmidt2013c] Michael Schmidt, Anja Fibich, and Gerhard Weber. MTIS: A multi-touch text input system. In Norbert Streitz and Constantine Stephanidis, editors, Distributed, Ambient, and Pervasive Interactions, volume 8028 of Lecture Notes in Computer Science, pages 62–71. Springer Berlin Heidelberg, 2013.

• [Schöning 2008] Johannes Schöning, Peter Brandl, Florian Daiber, Florian Echtler, Otmar Hilliges, Jonathan Hook, Markus Löchtefeld, Nima Motamedi, Laurence Muller, Patrick Olivier, Tim Roth, and Ulrich von Zadow. Multi-Touch Surfaces: A Technical Guide. Technical report, October 2008.

• [Spath2010] Dieter Spath, Anette Weisbecker (Hrsg.), Uwe Laufs, Micha Block, Jasmin Link, Antonino Ardilio, Andreas Schuller, Janina Bierkandt. Multi-Touch Technologie, Hard-/Software und deren Anwendungsszenarien. http://www.mt2009.iao.fraunhofer.de, 2010.

• [Völkel2008] Thorsten Völkel, Gerhard Weber, and Ulrich Baumann. Tactile Graphics Revised: The Novel BrailleDis 9000 Pin-Matrix Device with Multitouch Input. In ICCHP ’08: Proceedings of the 11th international conference on Computers Helping People with Special Needs, pages 835–842, Berlin, Heidelberg, 2008. Springer-Verlag.

• [Wobbrock 2006] Jacob O. Wobbrock, Scott E. Hudson, Jennifer Mankoff, and Richard C. Simpson. Edgewrite: A versatile design for text entry and control. Technical report, 2006.

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 78

Quellen - Websites

[gesturelib] http://openexhibits.org/gesturelibrary [Apple] http://www.apple.com/accessibility/iphone/vision.html [MSDN] http://msdn.microsoft.com/en-us/library/ff318625(v=surface.10).aspx [IFA2013] http://www.ifa-fiv.org/wp-content/uploads/2013/02/The-High-Cost-of-Low-Vision-The-

Evidence-on-Ageing-and-the-Loss-of-Sight.pdf [WHO2002]

http://www.who.int/blindness/GLOBALDATAFINALforweb.pdf [Orca] http://www.stephenbrandt.com/tango-icons/orca/orca.svg [JAWS]

http://www.karishmaenterprises.com/JAWS.htm [Dolphin]

http://www.yourdolphin.com/ [HyperBraille] http://www.apple.com/accessibility/iphone/vision.html

HyperBraille Projekt & Planare Gesten | Dipl. Inf. Michael Schmidt | 7. April 2014 79

Quellen - Websites

[opera] http://labs.opera.com/news/2009/04/01/ [operagestures] http://www.opera.com/browser/tutorials/gestures/ [Nintendo] http://www.nintendo.de/Nintendo-DS/Nintendo-DS/Nintendo-DS-116439.html [Surface] http://social.technet.microsoft.com/wiki/contents/articles/8017.microsoft-surface-1-0-sp1-

getting-started-guide-hardware-overview.aspx [PixelSense] http://www.microsoft.com/en-us/pixelsense/pixelsense.aspx http://www.microsoft.com/en-us/news/features/2011/nov11/11-17Surface.aspx [Wikimedia] http://commons.wikimedia.org/wiki/File:PalmPilot5000.jpg https://commons.wikimedia.org/wiki/File:Original_iPhone_docked.jpg http://commons.wikimedia.org/wiki/File:Samsung_Galaxy_Note.jpg [EvenGrounds]

http://evengrounds.com/blog/how-do-blind-people-use-the-computer [Wikipedia]

http://de.wikipedia.org/wiki/Screenreader