Christa Koch, Monika Weyer MODERNE ZEITEN DIE …

Transcript of Christa Koch, Monika Weyer MODERNE ZEITEN DIE …

157

MODERNE ZEITEN: DIE ERFORSCHUNG DER

HOHEN ATMOSPHÄRE UND DIE NUMERISCHE

WETTERVORHERSAGE

Trotz einiger Erfolge der empirischen Meteorologie zweifelten Ende des

19. Jahrhunderts aufgrund vieler dramatischer Fehlvorhersagen sowohl die

Bevölkerung als auch die Wissenschaft an der generellen Vorhersagbarkeit des

Wetters. Zugegeben, man hatte im vorangegangenen Jahrhundert die Bedeu-

tung der Tiefdruckgebiete für die Vorhersage des Wetters erkannt, die erarbei-

teten Regeln beruhten aber mehr auf Erfahrungen und Beobachtungen und nur

sehr wenig auf einem Verständnis für die physikalischen Zusammenhänge.

Immerhin waren in der zweiten Hälfte des 19. Jahrhunderts Gesetze gefun-

den worden, die den Wind als Folge der Druckverteilung erklärten. Christoph

Buys-Ballot formulierte 1856, dass der Bodenwind aufgrund der Erddrehung

spiralförmig im Uhrzeigersinn in ein Tief hineinfließt. Als Konsequenz muss die

Luft nach oben ausweichen, abkühlen und Wolken und schlechtes Wetter erzeu-

gen. Vilhelm Bjerknes zeigte, dass sich das Aufsteigen an Fronten verstärkt,

weil die leichtere Warmluft sich über die Kaltluft schiebt. Umgekehrt verursacht

das Absinken im Hoch Erwärmung, Wolkenauflösung und eine Tendenz zu schö-

nem Wetter. Damit war aber immer noch nicht geklärt, aus welchen Gründen

sich an manchen Stellen Hoch- und Tiefdruckgebiete bilden und nach welchen

Gesetzen sie sich verlagern – notwendige Vorraussetzung für eine gute Wetter-

vorhersage.

ERFORSCHUNG DER HOHEN ATMOSPHÄRE

Mit wachsenden technischen Möglichkeiten begann man, die Atmosphäre in

der Vertikalen zu erforschen – ein fulminanter Aufbruch in die dritte Dimension.

Schon im 19. Jahrhundert hatte man Messgeräte und Fotoapparate mit Ballo-

nen teilweise bis in 15 km Höhe geschickt. So erhielt man die ersten Luftbilder

von der Erde. Es folgten zahlreiche bemannte, häufig abenteuerliche Ballonauf-

stiege, 1902 erreichten Léon de Borc und Richard Aßmann in 10 bis 12 km die

»Obergrenze des Wetters«.

Anfang des 20. Jahrhunderts konnten dann auch die Besatzungen von Luft-

schiffen und Flugzeugen von den Wetterbedingungen in der Höhe berichten. Ab

1911 rief Aßmann den Warnungs- und Prognosedienst für Luftfahrer ins Leben,

der sich auf Pilotentelegramme aus verschiedenen deutschen Städten stützte.

Diese kamen aber häufig noch zu spät. 1934 zeichnete Richard Scherhag von

der Deutschen Seewarte in Hamburg die erste Höhenwetterkarte für eine Höhe

von 5,5 km.

Im Zweiten Weltkrieg flogen die Flugzeuge noch höher hinauf. Amerikani-

sche Bomberpiloten gerieten auf dem Weg nach Japan bei ihren geplanten

Christa Koch, Monika Weyer

158

Angriffswellen häufig in erheblichen Zeitverzug, mit schweren strategischen

Nachteilen. Grund dafür waren Starkwindbänder mit mehreren hundert Stun-

denkilometern Windgeschwindigkeit, so genannte Strahlströme (englisch: jet-

streams), wie sie regelmäßig in der hohen Atmosphäre auftreten. Manchmal

waren die Gegenwinde so stark, dass sie den Piloten das Vorankommen sogar

unmöglich machten.

Im Luftkrieg um England wurden Radargeräte erstmals zur Ortung von Nie-

derschlagsfeldern und nicht nur von Flugzeugen eingesetzt. Heute gibt es in

Europa ein Radar-Verbundnetz zur kontinuierlichen Niederschlagserfassung.

Die Gründung der WMO (World Meteorological Organisation) im Jahre 1950

erleichterte die globale Koordinierung und Standardisierung der Messungen

und Forschungsprogramme. Man erweiterte das Messnetz an seinen offensicht-

lichen Schwachstellen: 1948 wurden zehn ortsfeste Wetterschiffe im Atlantik

eingesetzt, die inzwischen überwiegend durch automatische Driftbojen ersetzt

worden sind. In der Vertikalen setzte und setzt man Radiosonden ein, Ballone,

die einfache Messgeräte für Druck, Temperatur und Feuchte bis in 30 km Höhe

159

tragen. 1960 wurde der erste Wettersatellit »Tiros 1« ins All geschossen. Er

maß die Infrarot-Strahlung der Erde und entdeckte prompt einen Hurrikan über

dem Atlantik. Dies wurde von der Öffentlichkeit begeistert aufgenommen, die

Meteorologen waren glücklich angesichts der neuen Datenfülle. Heute gibt es

ein System von Wettersatelliten, die die Erde ständig umkreisen und in der Lage

sind, eine Vielzahl von meteorologischen Größen räumlich zu erfassen. Unter

anderem kann aus dem All auch jeder Blitz auf der Erde registriert werden.

Zunehmend messen auch Linienflugzeuge routinemäßig das Wetter entlang

ihrer Strecke.

Die Höhenmessungen hatten schon früh enthüllt, dass die Strahlströme

in Wellenbewegungen aus Westen um die Hemisphäre laufen und dabei ständig

in der Größenordnung von Tagen ihre Lage verändern. Strömt in einem Bereich

dieser Höhenwinde mehr Luft ein als aus, muss aufgrund des zunehmenden

Gewichts der Luft der Luftdruck am Boden steigen – es bildet sich ein Hoch.

Strömt in einem Gebiet horizontal mehr Luft aus, fällt der Bodendruck. Letzt-

endlich erkannte man, dass die Vorgänge in der Höhe die Tiefdruckentwicklung

am Boden dirigieren. Die Verlagerung eines Tiefs wird durch die Richtung und

die Geschwindigkeit der Strahlströme bestimmt. So entsprechen die typischen

Zugbahnen, die Wilhelm Jakob van Bebber 1886 katalogisierte, den wichtigsten

Strahlstrompositionen über Mitteleuropa. Mit Hilfe der Höhenmessungen war

es nun möglich, diese Zugbahnen auch vorherzusagen.

DIE ÄRA DER NUMERISCHEN WETTERVORHERSAGE

Die Fortschritte in der Physik führten zur Formulierung von Gesetzen, mit

denen das Verhalten von Flüssigkeiten und Gasen mathematisch beschrieben

werden konnte. Zur Verfügung standen:

- der Erhaltungssatz der Energie

Energie kann nicht erzeugt oder vernichtet, sondern nur in eine andere Form

überführt werden. Zum Beispiel kann Sonnenstrahlung in Wärmeenergie

umgewandelt werden. Die Suche nach dem Perpetuum Mobile war schon

lange aufgegeben worden.

- der Erhaltungssatz der Masse

Auch Masse kann nicht verschwinden. Wenn in ein Luftvolumen mehr Masse

ein- als ausströmt, muss sich die Dichte erhöhen.

- der Erhaltungssatz von Impuls

Eine Bewegung ändert sich nicht, es sei denn, es wirken Kräfte; dieser

Erhaltungssatz war schon früh von Isaac Newton formuliert worden.

- und die Gasgleichung, die eine einfache Beziehung zwischen Druck, Tem-

peratur und Volumen herstellt und im Prinzip auf die frühen Experimente

mit der Luft zurückgeht. Die Messungen hatten gezeigt, dass, wenn in einem

festen Volumen die Temperatur zunimmt, auch der Druck ansteigt. Hinzu

kam noch die Bilanzgleichung für das Wasser in der Atmosphäre.

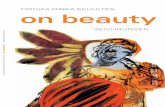

Linke Abbildung

Wetterkarte des deutschen Wetterdienstes:

Winterliche Hochdrucklage, 29. Januar 1949.

Die Wetterlage ist charakterisiert durch eine

mehrere hundert Meter mächtige Bodenkalt-

luftschicht mit mäßigem Frost, über der sich

absinkende trockene Warmluft befindet.

Foto Wetteramt Stuttgart aus der Reihe

»Wetterkunde I. Die Grundlagen der Wetter-

kunde«

Rechte Abbildung

Wetterkarte des deutschen Wetterdienstes:

Tiefdrucklage über Mitteleuropa, 27. Novem-

ber 1949. Die Wetterkarte zeigt ein Tief-

drucksystem mit Kern über Mitteleuropa; der

Westen ist durch Kaltluft bestimmt, im Osten

wird, meist in Verbindung mit einzelnen, sich

aus dem Mittelmeerraum nach Norden verla-

gernden Strömungen Warmluft nach Ost-

und Mitteleuropa geführt. Foto Wetteramt

Stuttgart aus der Reihe »Wetterkunde I. Die

Grundlagen der Wetterkunde«

160

Bjerknes publizierte 1904 auf nur sieben Seiten als erster einen Satz hydro-

dynamischer Gleichungen, der auf diesen Gesetzen beruhte. Damit konnte –

zumindest theoretisch – der Zustand der Atmosphäre von einer gegebenen

Anfangssituation in die Zukunft gerechnet werden. Im Gegensatz zu den

früheren »empirischen« Vorhersagen nannte man dieses Verfahren eine

»deterministische« Vorhersage. Das in diesem Jahrhundert zunehmend verbes-

serte Beobachtungsnetz lieferte die nötigen Anfangsbedingungen. Die Schwie-

rigkeit bestand darin, diesen Gleichungssatz zu lösen, denn die vielen zu

berechnenden Variablen sind darin auf äußerst komplexe Weise (räumlich und

zeitlich) miteinander verknüpft.

Der englische Mathematiker Lewis Fry Richardson war ein eigenwilliger Den-

ker, der in verschiedenen Wissenschaftszweigen ungewöhnliche Ideen entwick-

elte. Er realisierte, dass man die Gleichungen unmöglich für alle Orte, das heißt

für unendlich viele Punkte, lösen konnte. Bahn brechend war sein Ansatz, die

Erde mit einem Gitter zu überziehen und die Vorhersagegleichungen nähe-

rungsweise an den Eckpunkten des Gitters zu berechnen. Für jeden Gitterpunkt

wurden die Änderungen der meteorologischen Größen aus der gegebenen

Situation in der direkten Umgebung des Punktes in einem kleinen Schritt in die

Zukunft gerechnet. Die auf diese Weise neu entstandenen Gitterpunktsdaten

waren Ausgangspunkt für den nächsten Zeitschritt. Aus der Summe vieler klei-

ner Rechenschritte ergab sich seine erste und einzige Sechs-Stunden-Wetter-

vorhersage. Man schätzt, dass er dafür mehrere Monate rechnen musste.

Seine Prognose war allerdings mit einem vorhergesagten Druckfall von 145

Hektopascal fernab von dem tatsächlich beobachteten Wert von nur einem

Hektopascal. Trotz dieses Misserfolges veröffentlichte er selbstbewusst seine

Studie 1922 als Buch unter dem Titel »Numerische Wettervorhersage«. Halb im

Scherz malte er sich dort folgende Rechenfabrik für eine globale Wettervorher-

sage aus: Seine Rechner (englisch: computer) waren die nur mit Bleistift und

Papier arbeitenden Angestellten, sie saßen auf den Rängen eines kugelförmi-

gen Konzertsaals. Die Wände waren als Weltkarte gestaltet, mit dem Nordpol

unter der Decke und dem Südpol als Fußboden. In der Mittelsäule befand sich

ein »Dirigent«, der den Takt für die gleichzeitig durchzuführenden Rechen-

schritte angab. Die zu einem Zeitschritt berechneten Daten wurden per Licht-

zeichen an die direkten Nachbarn weitergeben. Richardson schätzte, dass für

eine zeitnahe globale Wettervorhersage 64 000 Mitarbeiter gebraucht wür-

den – eine Zahl, die immer noch viel zu niedrig angesetzt war.

Schließlich sollte die weitere Geschichte seinem Lösungsansatz in mehrfa-

cher Hinsicht Recht geben. Sein Taktverfahren wird zum Beispiel heutzutage

von modernen, parallel rechnenden Supercomputern eingesetzt. Außerdem

führte Jule Gregory Charney die numerische Wettervorhersage doch noch zum

Erfolg. Charney war nach dem Zweiten Weltkrieg für mehrere Jahrzehnte die

dominierende Figur der atmosphärischen Wissenschaften. Er zeigte, warum

Richardsons Versuch scheitern musste, und wie sich der Fehler beheben ließ: Die

Prognosegleichungen beinhalteten viele atmosphärische Prozesse, neben den

161

langsamen Druckänderungen zum Beispiel auch

Schallwellen, die sich mit sehr hohen Geschwindigkei-

ten ausbreiten. Diese erreichten in Richardsons Rech-

nungen den nächsten Gitterpunkt schon lange vor

Ablauf des gewählten Zeitschritts und führten damit

zu irrwitzigen Ergebnissen. Dieses Phänomen wird

numerische Instabilität genannt. Charney formulierte

Vorhersagegleichungen, die Schallwellen noch vor der

Programmierung herausfilterten.

Die erste erfolgreiche numerische Wettervorhersa-

ge gelang Charney 1949 auf einem »elektronischen

Rechner«, der zu diesem Zweck von seinem Kollegen,

dem Mathematiker John von Neumann gebaut worden

war. Sie rechneten mehr als 24 Stunden, unter ande-

rem, weil der Computer mehrfach abstürzte. Die darin

vorhergesagte Verlagerung der Strahlströme schickte

er ehrenhalber an Richardson, der die Begutachtung

der Ergebnisse seiner Frau überließ. Richardson hatte

beim englischen Wetterdienst gekündigt, als er nach

dem Ersten Weltkrieg die Ausbreitung von Giftgas

berechnen sollte. Als überzeugter Pazifist konzentrier-

te er sich nun auf numerische Modelle zum Verständ-

nis und zur Verhinderung von Kriegen. Zu seinem Bestürzen ergaben seine For-

schungen allerdings, dass Kriege sich nicht vermeiden lassen. Charney setzte in

seiner weiteren Arbeit Meilensteine in der Formulierung immer umfassenderer

und raffinierterer Prognosegleichungen. 1954 veröffentlichte er eine numeri-

sche Prognose der Entstehung von Tiefdruckgebieten an Fronten.

Das Prinzip der numerischen Wettervorhersage hat sich bis heute wenig

verändert. Seit Charney sind die Computerkapazitäten allerdings explosionsar-

tig gewachsen. Man konnte es sich leisten, sowohl die Gleichungen als auch die

Rechengitter in vielen Schritten zu verfeinern. 1954 wurde die erste regelmäßi-

ge numerische Wettervorhersage in Schweden ins Leben gerufen, 1955 folgten

die USA. 1958 verbreitete das US Weather Bureau die ersten numerisch erstell-

ten Höhenvorhersagen an die nationalen Wetterdienste über Faksimiles. Der

Deutsche Wetterdienst machte numerische Prognosen ab 1966 und erhielt in

den 1970er Jahren den für einige Zeit leistungsfähigsten Rechner Europas.

Numerische Modelle der heutigen Zeit haben Rechengitter, die die ganze

Welt umspannen, da das Wetter global zusammenhängt, nicht zuletzt auch

durch die um die ganze Hemisphäre wehenden Strahlströme. Die gängige Git-

terweite beträgt in unseren Breiten etwa 50 km, in der Vertikalen wird die

Atmosphäre in ungefähr 40 Schichten unterteilt. Die Zeitschritte hängen von

der Gitterweite ab und liegen im Minutenbereich. Um die Wettervorhersage in

dicht besiedelten Ländern zu verbessern, werden regionale Modelle mit feinerer

Unterteilung versehen und wie »Nester« in das globale Modell eingefügt. Ein

Der erste elektronische Rechner der Welt für

allgemeine Zwecke wurde an der Universität

von Pennyslvania, USA, in den späten

1940er Jahren erbaut, aus: Bruce Buckley,

Edward J. Hopkins und Richard Whitaker:

Wissen neu erleben. Wetter. München, Wien

und Zürich 2004, S. 168

162

solches Modell wird auch vom Deutschen Wetterdienst betrieben und ist letzt-

endlich für unsere nationale Vorhersage verantwortlich.

Viele Meteorologen sind Spezialisten in der Programmierung, zu ihren Auf-

gaben gehört es auch, die Vorhersagen ständig mit dem beobachteten Wetter

zu vergleichen und die Modelle dahingehend anzupassen. Mit dem auch in

Zukunft zu erwartenden Anstieg der Leistungsfähigkeit der Computer ist eine

weitere Verbesserung der Wettervorhersage zu erhoffen.

LANGFRISTVORHERSAGEN UND DAS

CHAOTISCHE VERHALTEN DER ATMOSPHÄRE

In ihrer Euphorie rechneten die Meteorologen noch vor einigen Jahrzehnten

damit, dass man irgendwann in der Lage sein würde, zeitlich weiter in die

Zukunft zu rechnen und so vielleicht den Schnee zu Weihnachten schon Ostern

vorhersagen zu können. In der Aufbruchsstimmung hatte man zwischenzeitlich

die Überlegungen des Hermann von Helmholtz, eines Spezialisten für verwirbel-

te Strömungen aller Art, vergessen. Er gab schon 1875, vielleicht vor dem Hin-

tergrund der Fehlprognosen seiner Zeit, zu bedenken, »dass wir nur solche Vor-

gänge in der Natur vorausberechnen und in allen beobachtbaren Einzelheiten

verstehen können, bei denen kleine Fehler im Ansatz der Rechnung auch nur

kleine Fehler im Endergebnis hervorbringen« (zit. n. Bernhardt 2003, S. 14).

Dies traf aber schon bei den von ihm beobachteten bodennahen Turbulenzen

nicht zu.

Erstes Wetterradargerät, Berlin, 1960;

Foto Deutscher Wetterdienst,

Offenbach am Main

163

Edward N. Lorenz, ein amerikanischer Mathematiker und Meteorologe,

arbeitete in den 1960er Jahren an Vorhersagegleichungen, die das Verhalten

von durch den Boden erwärmter und aufsteigender Luft beschrieben. Eines

Tages entdeckte er merkwürdige Abweichungen in den Ergebnissen, als er an

einen erfolgreichen Modelllauf einen zweiten Lauf zeitlich anschloss. Dabei

wählte er als Anfangsbedingungen einmal die vom Computer gespeicherten

Endwerte des ersten Laufs, einmal aber auch die handschriftlich notierten

Werte, die aber nur auf drei Stellen hinter dem Komma genau waren. Im Ergeb-

nis erhielt er riesige Abweichungen. Lorenz erkannte die Tragweite dieser Beob-

achtung: War – im Sinne von Helmholtz – die Atmosphäre grundsätzlich nicht

vorhersagbar? Ein ähnliches Modell zur Entstehung von Tiefdruckwirbeln an der

Polarfront lieferte bei leicht veränderten Anfangsbedingungen nach einigen

Tagen Wetterentwicklung ebenfalls jedes Mal andere Resultate. Da man aber

den Zustand der Atmosphären nie exakt überall zu einem bestimmten Zeit-

Das Global-Modell (GME) simuliert das

Wettergeschehen weltweit; das die ganze

Welt umspannende Rechengitter mit über

fünf Millionen Gitterpunkten eignet sich

besonders gut zur Vorhersage von Hoch-

und Tiefdruckgebieten mit dazugehörigen

Fronten; aus: Deutscher Wetterdienst.

50 Jahre Kompetenz für Wetter und Klima

(1952-2002). Offenbach am Main 2002,

S. 25

164

punkt kennen kann – zum Beispiel nicht den viel zitierten Flügelschlag eines

Schmetterlings –, setzte sich langsam die bittere Erkenntnis durch, dass lang-

fristige Wettervorhersagen prinzipiell unmöglich sind! Mit seinen Verwirbelun-

gen ist das Wetter eben nicht immer ein geordnetes, streng deterministisches

System, sondern zeigt nach ein paar Tagen ein chaotisches Verhalten. Ab die-

sem Zeitraum ist das Wetter unvorhersagbar. Lorenz’ Modell gilt als das erste

und bekannteste Beispiel für ein so genanntes deterministisches Chaos, ein an

sich geordnetes System, das aber trotzdem unvorhersagbar ist. Die Chaostheo-

rie fand auch in vielen anderen Wissenschaftsbereichen Eingang.

Heute behilft man sich damit, dass man die Vorhersagen parallel laufender

Wettervorhersagemodelle miteinander vergleicht (Ensemble-Vorhersage). So

kann man beobachten, nach wie vielen Tagen die Resultate anfangen, stark

voneinander abzuweichen. Bis dahin haben die Wettervorhersagen eine sehr

hohe Trefferquote. Danach ist der Zustand der Atmosphäre zu chaotisch, um

irgendeiner dieser Vorhersagen trauen zu können.

Immerhin analysierten Lorenz und seine Nachfolger auch, dass das Verhal-

ten des Wetters nicht vollständig beliebig ist, zum Beispiel sind im Juli beim der-

zeitigen Zustand unseres Klimas Temperaturen unter dem Gefrierpunkt extrem

unwahrscheinlich. Das Klima kann zwar verschiedene Zustände, aber nicht x-

beliebige Zustände annehmen, das heißt es gibt statistische Wahrscheinlichkei-

ten für den Zustand der Atmosphäre.

Klimamodelle sollen den statistischen Zustand der Atmosphäre unter vor-

gegebenen Bedingungen berechnen. Sie ähneln den globalen Wettervorhersa-

gemodellen, werden aber in vielen Läufen mit leicht veränderten Anfangszu-

ständen über Jahre hinweg gefahren. Aufgrund des chaotischen Verhaltens der

Atmosphäre erhält man unterschiedliche Wetterentwicklungen, die schließlich

alle zu einer Statistik zusammengefasst werden. So kann man studieren, wie

sich das Klima der Zukunft zum Beispiel bei einer weiteren Kohlendioxidanrei-

cherung in den nächsten Jahrzehnten verhält. Moderne Klimamodelle müssen

im Gegensatz zu den Wettervorhersagemodellen die langsamer arbeitenden

Systeme der Erde in ihren Wechselwirkungen mit der Atmosphäre mitsimulie-

ren, als da sind: die Ozeane, die Eisbedeckung, die Biosphäre und letztendlich

das voraussichtliche Verhalten der Menschen. Die Klimamodelle sagen derzeit

eine Erwärmung der mittleren Temperatur am Boden in unseren Breiten um ein

paar Grad in den nächsten 50 Jahren voraus.

KLEINSTE PROZESSE

Eine Schwierigkeit bei numerischen Wettervorhersagen sind die Wetterphä-

nomene, die auch noch durch die kleinsten der derzeitigen Gitterweiten nume-

rischer Modelle schlüpfen, wie zum Beispiel Gewitter. Das Modell kann mit sei-

nen Ergebnissen nur Gebiete mit einer hohen Gewitter- und Schauerwahr-

scheinlichkeit identifizieren, zum Beispiel in einem Tiefdruckgebiet mit Fronten

und einem Zustrom von feuchter Luft. Wo und wann genau sie sich entladen, ist

165

nicht vorherzusagen. So kommt es dann zu den üblichen Vorhersagen von Nie-

derschlagswahrscheinlichkeiten wie beispielsweise einer Schauerwahrschein-

lichkeit von 30 Prozent.

Viele der allerkleinsten Phänomene in der Atmosphäre sind noch nicht kom-

plett entschlüsselt. Die Verteilung positiv und negativ geladener Teilchen in

einer Gewitterwolke ist erforscht, der Blitz in seinen verschiedenen Phasen

fotografiert und analysiert. Es gibt unterschiedliche plausible Theorien zur

Ladungstrennung. Ihre Überprüfung durch Messungen in einem Gewitter ist

jedoch äußerst schwierig, wenn nicht gar unmöglich.

VERBREITUNG

Heutzutage stellt die schnelle Verbreitung der Wettervorhersage keine

technische Schwierigkeit mehr dar. Der Output der Wettervorhersagecomputer

wird so schnell wie möglich aufbereitet, zu einem großen Teil maschinell,

manchmal sieht auch noch ein erfahrener Meteorologe über das Ergebnis.

Schnellster Verbreitungsweg ist heutzutage das Internet, dazu kommen

Radio, Fernsehen, Zeitungen, telefonische Ansagedienste und das Handy. Die

Ergebnisse werden seit Jahrzehnten vom Deutschen Wetterdienst und immer

mehr auch von vielen privaten Anbietern vermittelt.

Die Wettervorhersagen treffen auf einen mehr oder weniger kundigen Nut-

zer. Aufklärung wird in kleinen Dosen mit mancher Wettervorhersage mitgelie-

fert, außerdem in Wissenschaftssendungen, Museumsaustellungen, Kinderbü-

chern und als Schulstoff. Auf der anderen Seite wurden Wetterkarten zuneh-

mend bildhafter gestaltet. Und eines Tages verschwanden die Fronten in den

Wetterkarten bei der ARD, weil man die Zuschauer nicht überfordern wollte.

Linke Abbildung

Wetterzentrale des DWD, 16. Dezember

2005; Foto Deutscher Wetterdienst,

Offenbach am Main

Rechte Abbildung

Unwetterwarnung per Handy; Foto West-

fälische Provinzial Versicherung Aktienge-

sellschaft, Abteilung Schadenverhütung,

Münster

166

Viele zusätzliche Daten sind für den Interessierten im Internet zu finden.

Sequenzen von Satellitenbildern zeigen die Wolkenentwicklung, Sequenzen

von Radarbildern die Niederschlagsverteilung der letzten Stunden. Dies ermög-

licht dem Nutzer das so genannte »Nowcasting«: Das letzte Radarbild zeigt

ihm, wie weit der Regen noch entfernt ist, und hilft ihm damit manchmal besser

bei seiner Entscheidung, ob er auf dem Weg zur Arbeit einen Regenschirm mit-

nehmen sollte, als die Wettervorhersage im Morgenradio, die schon Stunden

vorher berechnet wurde.

Speziell aufbereitet werden die Vorhersagen für besondere Kunden bezie-

hungsweise Wirtschaftszweige, wie zum Beispiel die Seefahrt und den Flugwet-

terdienst, in den 40 Prozent des Aufwandes des Deutschen Wetterdienstes flie-

ßen. Piloten und Kapitäne zur See als Nutzer erhalten in ihrer Ausbildung aus-

führliche Schulungen in Wetterkunde, um die Informationen auch entsprechend

verwerten zu können.

Für die Landwirtschaft erforscht der Agrarmeteorologische Dienst in

Deutschland die Zusammenhänge zwischen Wetter und Pflanzenwachstum,

Tierkrankheiten oder Schädlingsbefall. Daher kann der zugehörige Beratungs-

dienst beispielsweise günstige Termine für die Schädlingsbekämpfung benen-

nen oder eine Blühvorhersage für Obst machen.

Witterungsvorhersagen, das heißt langfristige statistische Vorhersagen,

zum Beispiel von der Art, ob ein besonders strenger Winter zu erwarten ist, wie

sie auch in vielen Bauernregeln formuliert wurden, sind ein Ziel wissenschaftli-

cher Bemühungen. Im Erfolgsfall wäre der wirtschaftliche Nutzen ungeheuer.

Satellitenbild vom METEOSAT 8, 22. August

2005, 11:45; Foto Deutscher Wetterdienst,

Offenbach am Main

Radarbild vom 3. März 2003, Wetterlage

über Deutschland; Foto Deutscher Wetter-

dienst, Offenbach am Main

167

METEOSAT-Satellitenbilder über Europa vom 3. März 2005;

Fotos Deutscher Wetterdienst, Offenbach am Main

156 Die 2002 meldenden meteorologischen

Beobachtungsstationen an der Erdober-

fläche; sie speisen bis zu achtmal täglich in

das globale Telekommunikationsnetz der

WMO (World Meteorological Organization)

ein. Auffallend ist die geringe Stationsdichte

über dem südlichen Ozean und in den pola-

ren Breiten. Quelle: ECMWF (European Centre

for Medium-Range Weather Forecasts),

aus: Klima. Das Experiment mit dem Planeten

Erde. Hrsg. Walter Hauser. Stuttgart 2002,

S. 24