Steigerung der Anzahl der wahrgenommenen Farbabstufungen ... · Im Gegensatz dazu steht die Fovea...

Transcript of Steigerung der Anzahl der wahrgenommenen Farbabstufungen ... · Im Gegensatz dazu steht die Fovea...

Universität des SaarlandesLehrstuhl für Mikroelektronik

Bachelorarbeit

Steigerung der Anzahl der

wahrgenommenen Farbabstufungen

bei Displays durch digitale

Halbtonverfahren

Verfasser: Michaela Ney

Matrikelnr: 2528704

Studiengang: Computer- und

Kommunikationstechnik

Leitung: Prof. Dr.-Ing. Chihao Xu

Betreuung: Dipl.-Ing. Pascal Volkert

Universität des Saarlandes, 23. Juni 2014

Eidesstattliche Erklärung Ich erkläre hiermit an Eides Statt, dass ich die vorliegende Arbeit selbstständig verfasst und keine anderen als die angegebenen Quellen und Hilfsmittel verwendet habe.

Statement in Lieu of an Oath I hereby confirm that I have written this thesis on my own and that I have not used any other media or materials than the ones referred to in this thesis.

Saarbrücken, …………………………….. …………………………………………. (Datum / Date) (Unterschrift / Signature)

Einverständniserklärung Ich bin damit einverstanden, dass meine (bestandene) Arbeit in beiden Versionen in die Bibliothek der Informatik aufgenommen und damit veröffentlicht wird.

Declaration of Consent I agree to make both versions of my thesis (with a passing grade) accessible to the public by having them added to the library of the Computer Science Department.

Saarbrücken, …………………………….. …………………………………………. (Datum / Date) (Unterschrift / Signature)

Danksagung

Im Laufe meines Studiums und auch im Rahmen dieser Bachelorarbeit haben michviele Leute unterstützt, denen ich an dieser Stelle meinen Dank aussprechen möchte.Zunächst danke ich Herrn Prof. Dr.-Ing. Xu, der mir die Möglichkeit gab, am Lehr-stuhl für Mikroelektronik diese Bachelorarbeit zu verfassen.Ebenfalls ein großes Danke geht an meinen Betreuer Dipl.-Ing. Pascal Volkert, dertrotz meiner vielen Fragen nie die Geduld verloren hat und mir auch sonst mit Ratund Tat bei der Lösung vieler kleiner und größerer Probleme zur Seite stand.Nicht zu vergessen sind alle anderen LME- und Ex-LMEler, für die aufschlussreichenFrühstücks- und sonstigen Essenspausen, die gemeinsamen Events und nicht zuletztdie angenehme Arbeitsatmosphäre. Vielen Dank dafür!Ein großer Dank geht an alle meine Freunde aus Schul- und Studienzeit, für tolleEvents (vor allem die Spieleabende und Touren), die ich ab und zu gebraucht hab, ummal wieder abzuschalten. Ein besonderer Dank geht an Manuel Bastuck fürs zuhörenund „dummlabern“ und nicht zuletzt seine Hilfe durch das Korrekturlesen dieser Ar-beit. Ich danke insbesondere auch Michael Braun für seine Geduld und Unterstützungsowohl während des Studiums als auch in allen anderen Lebenslagen.Zuletzt geht das größte Dankeschön an meine Familie, die mir dieses Studium zeitlichwie finanziell überhaupt erst ermöglicht haben und ihren Glauben in mich dieses Stu-dium erfolgreich abschließen zu können.Auch an alle Personen, die ich vergessen habe, Danke!

II

Abstract

The focus of this thesis is digital halftoning. The number of visually perceived grayle-vels of displays can be increased by this and, therefore, an improvement of the displayquality is possible. For this purpose the thesis will firstly focus on the human visualperception and several important aspects of image quality assessment. An importantpart of this thesis is developing of a simulation environment for a display system.Afterwards, a selection of various digital halftone techniques will be added to this si-mulation environment. A first evaluation of the results gained from the simulation, i.e.the obtained test images, is performed by an objective image quality assessment me-thod (Visual Information Fidelity). In the end, the values which are computed by thisobjective method will be discussed and compared against the subjectively perceivedimage quality.

III

Kurzzusammenfassung

Im Fokus dieser Arbeit stehen digitale Halbtonverfahren. Durch sie ist eine Steigerungder Anzahl der wahrgenommenen Farbabstufungen und damit eine Verbesserung derDarstellungsqualität bei Displays möglich. Es wird zunächst auf die menschliche vi-suelle Wahrnehmung und einige, zur Beurteilung der Bildqualität, wichtigen Aspekteeingegangen. Einen wichtigen Teil dieser Arbeit bildet die Entwicklung einer Simulati-onsumgebung für ein Displaysystem. Anschließend wird eine Auswahl an verschiedenendigitalen Halbtonverfahren integriert. Eine erste Evaluierung der aus der Simulationgewonnenen Ergebnisse, das heißt der entstehenden Testbilder, erfolgt durch ein objek-tives Bewertungskriterium (Visual Information Fidelity). Die daraus erhaltenen Wertewerden am Ende der Arbeit diskutiert und mit der subjektiv wahrgenommenen Bild-qualität verglichen.

IV

Inhaltsverzeichnis

1. Einleitung 1

1.1. Motivation . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 11.2. Aufbau der Arbeit . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 2

2. Grundlagen 3

2.1. Menschliche Wahrnehmung . . . . . . . . . . . . . . . . . . . . . . . . . 32.1.1. Anatomie . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 32.1.2. Human Visual System (HVS) . . . . . . . . . . . . . . . . . . . . 5

2.2. Bewertung der Bildqualität . . . . . . . . . . . . . . . . . . . . . . . . . 92.2.1. Visual Information Fidelity . . . . . . . . . . . . . . . . . . . . . 11

2.3. Digitale Halbtonverfahren . . . . . . . . . . . . . . . . . . . . . . . . . . 132.4. AMOLED-Displays . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 182.5. Gammakorrektur . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 21

3. Implementierung und Validierung digitaler Halbtonverfahren 23

3.1. Problemstellung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 233.2. Simulation digitaler Halbtonverfahren . . . . . . . . . . . . . . . . . . . 243.3. Verwendete Halbtonverfahren . . . . . . . . . . . . . . . . . . . . . . . . 25

3.3.1. Ordered Dither nach Bayer . . . . . . . . . . . . . . . . . . . . . 263.3.2. Look-Up-Tables . . . . . . . . . . . . . . . . . . . . . . . . . . . . 273.3.3. Error Diffusion . . . . . . . . . . . . . . . . . . . . . . . . . . . . 30

3.4. Ergebnisse und Auswertung . . . . . . . . . . . . . . . . . . . . . . . . . 31

4. Zusammenfassung und Ausblick 45

Literatur i

A. Anlagen xi

A.1. IQA-Methoden . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . xiA.2. Digitale Halbtonverfahren . . . . . . . . . . . . . . . . . . . . . . . . . . xiiA.3. Human Visual System Modell - Saliency Maps . . . . . . . . . . . . . . xiii

V

Abkürzungsverzeichnis

AM Amplitudenmodulation, engl. Amplitude Modulation

AMOLED Aktive Organische Leuchtdioden Matrix, engl. active-matrix organiclight-emitting diode

CSF Kontrastschwellenfunktion, engl. Contrast Sensitivity Function

FM Frequenzmodulation, engl. Frequency Modulation

FRC Engl. Frame-Rate-Control

HVS Menschliches visuelles Wahrnehmungssystem, engl. Human Visual System

IQA Bildqualitätsanalyse, engl. Image Quality Assessment

JND Gerade wahrnehmbarer Unterschied, engl. Just Noticeable Difference

LCD Flüssigkristalldisplay, engl. liquid-crystal display

LED Leuchtdiode, engl. light-emitting diode

LSB Niedrigstwertiges Bit, engl. Least Significant Bit

LUT In Speicher hinterlegte Nachschlagetabelle, engl. Look-Up-Table

MSB Höchstwertigstes Bit, engl. Most Significant Bit

OLED Organische Leuchtdiode, engl. organic light-emitting diode

PMOLED Passive Organische Leuchtdioden Matrix, engl. passive-matrix organiclight-emitting diode

PWM Pulsweitenmodulation, engl. pulse-width modulation

RGB Rot, Grün, Blau, engl. red, green, blue

ROI Interessenbereich, engl. Region of Interest

TFT Dünnschichttransistor, engl. thin-film transistor

VGA Engl. video graphics array

VIF Visuelle Informationsgenauigkeit, engl. Visual Information Fidelity

VI

1. Einleitung

1.1. Motivation

Aus der heutigen Zeit sind Displays praktisch nicht mehr wegzudenken. Vor allemmit der Verbreitung und Zugänglichkeit des Internets steigt der Bedarf an Smartpho-nes, Laptops, Tablets, etc. immer weiter an. In diesen stellen Displays die Schnittstellezwischen Mensch und Maschine dar. Da im alltäglichen Gebrauch die ständige Erreich-barkeit auch unterwegs zunehmend an Bedeutung gewinnt, werden an Displays immerhöhere Erwartungen gestellt. Sie müssen leicht und dünn sein und eine hohe Akku-laufzeit erlauben. Nichtsdestotrotz muss eine hohe Bildqualität gewährleistet sein.Die Bildqualität eines Displays hängt von vielen unterschiedlichen Faktoren wie Kon-trastverhältnis, Farbe, Schärfe und auch vom verwendeten Halbtonverfahren ab. FürDisplaysysteme gibt es zwischen Gammakorrektur, Farbkontrolle, Datenumsetzung,Halftoning, Bildoptimierung, das Entrauschen von Bildern, usw., viele verschiedeneTechnologien zur Steigerung der Bildqualität. Um 8-Bit-Bilddaten nach einer Gamm-akorrektur korrekt darzustellen, sind üblicherweise 18 Bit notwendig. Derzeit verbrei-tete LCDs (Flüssigkeitskristallanzeige, engl. liquid-crystal displays) und AMOLED-Displays (Organische Leuchtdioden-Displays mit Aktivmatrix, engl. active-matrix or-ganic light-emitting diode displays) können allerdings nur etwa 10 Bit darstellen, wes-halb mithilfe digitaler Halbtonverfahren fehlende Stufen zur Korrektur der Darstellungerzeugt werden, welche wiederum auf der Eigenschaft des menschlichen Auges beru-hen, die Farbstufen benachbarter Punkte beziehungsweise Flächen bei ausreichendemAbstand zu einer Zwischenstufe zu vermischen. Durch digitale Halbtonverfahren kannso eine Steigerung der Bildqualität erreicht werden.Stand der Technik ist bis dato die Verwendung einfacher Halbtonverfahren, wie Floyd-Steinberg Error Diffusion und Ordered Dither Algorithmen, da diese Speichereffizienzund Echtzeitfähigkeit aufweisen. Dennoch sind diese Verfahren bekannt dafür, sicht-bare Artefakte im Bild zu produzieren. In dieser Arbeit wird ein Überblick über einigekonventionelle Verfahren, darunter auch die eben genannten, gegeben. Deren Imple-mentierung liegt im Allgemeinen allerdings nur für das zweistufige Halftoning vor. Beider Betrachtung von Displays ist jedoch eine Erweiterung zum mehrstufigen Halfto-ning notwendig. Zusätzlich kann durch die Verwendung von Halbtonverfahren, die aufLook-Up-Tabellen beruhen, Echtzeitfähigkeit erreicht werden.Am Lehrstuhl für Mikroelektronik wird zurzeit in Kooperation mit der Firma Vision-ox an einem AMOLED-Display gearbeitet. Dessen Verhalten und damit einhergehendauch dessen visuelle Resultate bei der Verwendung unterschiedlicher digitaler Halb-tonverfahren zur Verbesserung der darstellbaren Farbtiefe sollen im Rahmen dieserArbeit simuliert werden. Um die daraus gewonnenen Testbilder auszuwerten, wird zu-

1

dem auf Verfahren zur Bewertung der Bildqualität eingegangen. Diese basieren aufeinigen grundlegenden Eigenschaften der menschlichen visuellen Wahrnehmung undbilden somit eine effiziente Technologie, die entstehenden Halbtonbilder zu evaluieren.

1.2. Aufbau der Arbeit

In dieser Arbeit wird zunächst ein Überblick über die Grundlagen der menschlichenWahrnehmung gegeben. Einige daraus gewonnene bekannte Eigenschaften des mensch-lichen Wahrnehmungssystems werden unter anderem in Verfahren zur Analyse derBildqualität benutzt. Eines dieser Verfahren wird im Folgenden kurz dargelegt undspäter zur Bewertung der entstehenden Testbilder herangezogen. Danach folgt eineallgemeine Beschreibung digitaler Halbtonverfahren, von denen später einige Metho-den genauer skizziert und letztlich auf die Testbilder angewandt werden. Vorher wirdjedoch auf das AMOLED-Display, dessen Verhalten für unterschiedliche digitale Halb-tonverfahren im Hauptteil simuliert werden soll, eingegangen. Anschließend folgt einegenauere Beschreibung der Implementierung eines solchen Simulators und der dabeiverwendeten digitalen Halbtonverfahren. Im letzten Schritt erfolgt die Validierung deraus der Simulation gewonnenen Resultate. Abschließend werden die gewonnen Er-kenntnisse noch einmal kritisch betrachtet und ein Ausblick mit möglichen Verbesse-rungen gegeben.

2

2. Grundlagen

2.1. Menschliche Wahrnehmung

Die menschliche Wahrnehmung ist ein komplexer Prozess, der von vielen verschiede-nen Faktoren wie beispielsweise Beleuchtung, Abstand, Hintergrund und Blickwinkelbeeinflusst wird. Diese Faktoren tragen unter anderem auch dazu bei, dass bei der vi-suellen Aufnahme und Verarbeitung eines Bildes unterschiedliche Artefakte auftretenkönnen. Um ein Bild auf einem Display so darzustellen, dass es vom Menschen wiegewünscht wahrgenommen wird, muss man demnach einige Grundlagen der visuellenWahrnehmung beachten. Dazu soll zunächst kurz auf das menschliche visuelle Systemeingegangen werden [Vol13].

2.1.1. Anatomie

Abbildung 2.1.: Aufbau des menschlichen Auges [Miß].

Die Basis zur visuellen Wahrnehmung bildet die Interaktion der Augen mit demGehirn durch ein Netzwerk von Neuronen, Rezeptoren und anderer spezieller Zellen.Der Aufbau des Auges ist in Abbildung 2.1 dargestellt. Es reagiert auf elektroma-gnetische Strahlung im Wellenlängenbereich 380 nm bis 780 nm. Von außen wird esunter anderem durch die Lederhaut (Sklera) geschützt, welche an der Vorderseite vonder durchsichtigen Hornhaut (Cornea) unterbrochen wird. Diese wiederum bildet dieerste brechende Schicht, durch die Licht einfällt. Das Licht wandert weiter durch die

3

Pupille, eine Öffnung in der Mitte der Regenbogenhaut (Iris). Der Lichteinfall kanndabei gesteuert werden, indem Muskeln die Pupillengröße verändern. Die hinter derPupille liegende Augenlinse bricht die einfallenden Lichtstrahlen und projiziert diesedurch den kugelförmigen Glaskörper auf die Netzhaut (Retina). Die Akkommodationder Augenlinse erfolgt hierbei durch Ziliarmuskeln. Die Retina bildet die eigentliche,lichtempfindliche Schicht. Auf ihr sitzen die Fotorezeptoren, die sogenannten Stäbchen(engl. „rods“) und Zäpfchen (engl. „cones“) . Diese detektieren Farbtöne und Helligkeit.Es folgt eine Umwandlung der Lichtsignale in elektrische Signale, welche dann überden Sehnerv an das Gehirn weitergeleitet werden. Am Austrittsort des Sehnervs vomAuge befinden sich keine Sinneszellen, weshalb er den Namen „blinder Fleck“ trägt.Im Gegensatz dazu steht die Fovea (Makula oder auch gelber Fleck), die die Stelle desschärfsten Sehens darstellt. Ein Lichtstrahl, der senkrecht durch die Pupille geht, trifftgenau auf dieser Stelle auf.Ein großer Teil der Signalverarbeitung geschieht noch im Auge selbst, d.h. bevor dieLichtsignale über den Sehnerv an das Gehirn weitergeleitet und dort in Farb- oderSchwarz-Weiß-Bilder umgewandelt werden. Die wichtigste Rolle spielen hierbei dieeben genannten lichtempfindlichen Sinneszellen beziehungsweise Fotorezeptoren. Vonden ca. 130 Millionen Fotorezeptoren sind etwa 95 % Stäbchen und 5 % Zäpfchen. Letz-tere konzentrieren sich im Bereich der Fovea und nehmen zum Sehfeldrand hin rapideab, wo sich fast nur noch Stäbchen befinden (vergleiche auch Abbildung 2.2). Die Auf-gabe der beiden Zellarten ist die Messung der Helligkeit (Stäbchen) beziehungsweisedes Farbanteils (Zäpfchen) eines einfallenden Lichstrahls. Die etwa 1000 Mal emp-findlicheren Stäbchen sind für das skotopische Sehen (Nachtsehen) zuständig. Beimalleinigen Stimulieren der Stäbchen entstehen jedoch lediglich unscharfe Graustufen-bilder. Zäpfchen dagegen werden erst ab einer Mindestanzahl einfallender Photonenerregt, tragen dann aber durch das Auflösen von Farben zum wesentlich detailreiche-ren photopischen Sehen bei. Es gibt drei Arten von Zäpfchen, weshalb man auch vomtrichromatischen Sehen spricht: die rotempfindlichen L-Zäpfchen (L für Long, langeWellenlänge), grünempfindliche M-Zäpfchen (M für Medium, mittlere Wellenlänge)und blauempfindliche S-Zäpfchen (S für Short, kurze Wellenlänge). Zwischen den 130Millionen Fotorezeptoren und der nur etwa einer Millionen Zellen (sogenannte „Gangli-enzellen“), welche direkt mit dem Sehnerv verbunden sind, befindet sich eine komplexaufgebaute Schicht zur Verschaltung der Fotorezeptoren, auf die hier nicht näher ein-gegangen wird. Letztlich werden nach der Vorverarbeitung Informationen über die dreiKomponenten Farbton, Sättigung und Helligkeit an das Gehirn weitergeleitet [Wag].Aus den drei Farben Rot, Grün und Blau können durch unterschiedliche Helligkeitenalle anderen Farben (über 16 Millionen) erzeugt werden, was man sich beispielsweisebei Displays zunutze macht. Bei diesen werden daher meistens nur diese drei Pixelfar-ben verwendet [Joh04] [CCF12]. Einige Eigenschaften der menschlichen Wahrnehmunginfolge der anatomischen Grundlagen des Auges sind besonders wichtig. Diese werdenzur Modellierung des sogenannten „Human Visual System“ genutzt. Was man dar-unter versteht und welche der Eigenschaften besonders hervorzuheben sind, wird imnächsten Abschnitt diskutiert.

4

2.1.2. Human Visual System (HVS)

(a) (b)

Abbildung 2.2.: (a) Stäbchen- und Zäpfchen-Verteilung im menschlichen Auge [Fun].(b) Nach einiger Zeit wird vom Auge die Gestalt eines Dalmatiners imBild wahrgenommen [Sch].

Die visuelle Wahrnehmung des Menschen ist sehr komplex, daher ist eine mathema-tisch genaue Beschreibung nahezu unmöglich. Allerdings hat man im Laufe der Zeitmehrere Modelle entwickelt, welche unterschiedliche Eigenschaften des menschlichenAuges nachbilden.Die Basis eines Human-Visual-System-Modells (kurz: HVS-Modell) ist, dass die Sen-sibilität des visuellen Systems für verschiedene Aspekte des wahrgenommenen Signalsvariiert. Zu diesen Aspekten gehören Helligkeit, Kontrast, Frequenzgehalt und diewechselseitige Beeinflussung zweier Signalkomponenten. Metriken zur Qualitätsbewer-tung von Bildern (Image-Quality-Assessment-(IQA)-Metriken) können unter Berück-sichtigung der genannten Faktoren beispielsweise ein Maß für die Größe des wahrge-nommenen Fehlers zwischen Test- und Referenzsignal berechnen [ACBV05]. Weiterhinwerden im Zusammenhang mit dem HVS sogenannte „Saliency Maps“ (vergleiche auchAnhang) erforscht. Hiernach gibt es einen Bereich (ein Objekt, einen Pixel oder einenMenschen), auf welchen sich nahezu die gesamte Aufmerksamkeit richtet. SaliencyMaps sind in der Lage, solche visuell herausragenden Regionen (auch „Region of In-terest“ (ROI, dt. Interessenbereich)) eines Bildes automatisch zu erfassen [AS10]. Siebilden neben Sichtverhältnissen, Wahrnehmung und perzeptuellen Gruppierungsvor-gängen einen wichtigen Teil des HVS-Modells [FA13] [Meu+05].Zur Modellierung des menschlichen Wahrnehmungssystems macht man sich einige

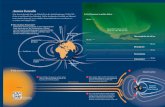

Besonderheiten zunutze. Zunächst nutzt man aus, dass der Mensch nur eine begrenzteAnzahl an Stäbchen hat, weshalb das Auge als Tiefpass für räumliche Frequenzen an-gesehen werden kann. Die räumliche beziehungsweise Ortsfrequenz ist definiert als dieHäufigkeit festgelegter periodischer Erscheinungen mit Bezug auf die räumliche Ent-fernung zueinander (zum Beispiel die Anzahl der Wechsel zwischen hellen und dunklenFlächen, vergleiche auch Abbildung 2.4). Ferner ist durch die deutlich geringere An-

5

Abbildung 2.3.: Darstellung der Farbe violett durch die Verwendung roter und blauerVierecke, indem die Distanz zum Betrachter (in diesem Fall durchVerkleinerung der Vierecke) erhöht wird. [Jal].

zahl an Zäpfchen die menschliche Farbauflösung begrenzt. Überdies sind Menschen vorallem im peripheren Sichtfeld bewegungsempfindlich. Die Sensibilität für Strukturenund Missverhältnisse ist dort dagegen wesentlich schwächer. Ein weiterer wesentlicherAspekt der menschlichen Wahrnehmung ist die Gesichts- und Objekterkennung. Gene-rell lässt sich festhalten, dass ständig Unbekanntes mit Bekanntem abgeglichen wird.So erkennt man bei längerem Hinsehen auf Abbildung 2.2 die bekannte Gestalt einesDalmatiners.Örtliche und zeitliche Auflösung des Auges sind insbesondere bei der Konstruktion,Konzeption und Ansteuerung von Displays von Interesse. So kann durch eine hoheBildwiederholrate beispielsweise ein Bild erzeugt werden, das kontinuierlich und sta-tisch wahrgenommen wird. Dazu ist eine Bildwiederholrate höher als 60 Hz notwen-dig, ab welcher das Bild flimmerfrei wahrgenommen wird. Ein anderer Aspekt ist dieDarstellung von Bewegtbildern wie beispielsweise bei einem Kinofilm. Um durch auf-einanderfolgende Bilder eine Bewegung darzustellen sind etwa 24 Bilder pro Sekundenötig, wobei die Anzahl dieser unter anderem auch von der Bewegungsgeschwindigkeitdes Objekts abhängt.Ein weiterer Aspekt ist die örtliche Integration des Auges. Um die Auflösung einzel-ner Pixel zu vermeiden und somit den Eindruck einer homogenen Fläche zu erwecken,muss das örtliche Auflösungsvermögen und damit auch der Abstand zum Objekt mit-einbezogen werden (vergleiche Abbildung 2.3).Nachfolgend werden einige HVS-Modelle kurz vorgestellt. Die HVS-Modelle findensowohl in Metriken zur Qualitätsbewertung von Bildern (Image-Quality-Assessment-(IQA)-Metriken) Anwendung als auch in digitalen Halbtonverfahren, vergleiche Ab-schnitt 2.2 und 2.3.

6

Modelle

Abbildung 2.4.: Zusammenhang zwischen CSF und Ortsfrequenz (in Perioden pro Seh-winkelgrad) [Sac06].

In diesem Abschnitt sollen kurz einige verschiedene HVS-Modelle vorgestellt werden[LF04]. Es gibt prinzipiell drei Grundeigenschaften des menschlichen Wahrnehmungs-systems, welche die meisten Modelle berücksichtigen. Dazu gehören die Sensibilitätgegenüber Frequenz und Luminanz sowie Kontrastmaskierungs-Effekte. Frequenzsen-sibilität erfasst die menschliche Wahrnehmung auf verschiedene Ortsfrequenzen. Lu-minanzsensibilität dagegen ist ein Maß für die Nachweisbarkeit von Rauschen auf ei-nem konstanten Hintergrund. Entsprechend der Änderung der Hintergrundbeleuch-tung wird dabei die Frequenzsensibilität angepasst. Der Effekt, bei dem ein Signal inGegenwart eines anderen Signals (Maske) an Sichtbarkeit verliert, wird als Maskierungbezeichnet.Das menschliche Wahrnehmungssystem beruht im wesentlichen auf den Kontrastver-hältnissen einer betrachteten Szene. Durch diese können einzelne Elemente unterschie-den werden. Bei der Konstruktion eines linearen HVS-Modells können die Effekte,welche der Kontrast auf die visuelle Auflösung einer Szene hat, durch die Kontrast-grenze des Systems ausgedrückt werden. Um diese Kontrastschwelle (engl. „contrastthreshold“) zu bestimmen, wurde der Zusammenhang zwischen Kontrast und Lumi-nanz eingehend untersucht. Der Kontrast ist nach Michelson durch folgende Gleichungdefiniert

Lmax − Lmin

Lmax + Lmin, (2.1)

7

wobei Lmax und Lmin die maximale beziehungsweise minimale Leuchtdichte bezeich-nen [Smi78]. Infolgedessen kam es zur Entwicklung von Kontrastschwellenfunktionen(Contrast Sensitivity Function, CSF), welche zur Entwicklung einfacher, bildunab-hängiger Modelle verwendet werden. Sie zeigen an, dass das menschliche HVS amempfindlichsten auf Ortsfrequenzen zwischen 5 und 10 Perioden pro Sehwinkelgradreagiert. Der Sehwinkelgrad ist ein Maß dafür, ab welchem Sehwinkel das Auge einObjekt von einem anderen Objekt unterscheiden kann. Dieser Winkel hängt sowohlvon der Distanz des Betrachters zum Objekt als auch von der Ausdehnung des Objektsselbst ab. Der Kontrast wird nach der CSF in diesem Bereich folglich am deutlichstenempfunden. Während bei niedrigen Ortsfrequenzen die Streifen in Abbildung 2.4 „ver-waschen“ wirken, scheinen sie bei hohen Frequenzen miteinander zu verschmelzen undsind nicht mehr als einzelne Streifen, sondern als graue Fläche wahrzunehmen. Zudemist zu sehen, dass sich die CSFs für Tages- (photopic), Dämmerungs- (mesopic) undNachtsehen (scotopic) voneinander unterscheiden.Eine Klasse von HVS-Modellen basiert auf DCT (Discrete Cosine Transform) oderDWT (Discrete Wavelet Transform, dt. Diskrete Wellentransformation) und wurdeursprünglich zur Bildkomprimierung entwickelt. Dabei war eine gute Quantisierungs-matrix notwendig, um eine bessere Qualität für stark komprimierte Bilder zu liefern.Ein Signal ist nach den auf DCT-basierenden Modellen unbedeutend oder nicht wahr-nehmbar, falls es kleiner als die experimentell bestimmte zugehörige „Just NoticeableDifference“ (JND, dt. gerade wahrnehmbarer Unterschied) ist. Die JND hängt unteranderem von den horizontalen beziehungsweise vertikalen Ortsfrequenzen ab und kanndurch Berücksichtigen der Luminanzsensibilität und weiterer Maskierungseffekte nochangepasst werden. Je mehr Eigenschaften des HVS mit einkalkuliert werden, destokomplexer aber auch besser wird das Modell.Die DWT spaltet ein Signal in je ein Hochpasssignal (Detail) und ein Tiefpasssignal(Näherung). Das Tiefpasssignal kann wiederum weiter in ein Detail und eine Näherunggespalten werden. Dieser Prozess lässt sich beliebig oft wiederholen. Bilder oder anderezweidimensionale Signale werden so in Teilbänder zerlegt, welche in Ortsfrequenz undOrientierung variieren. Hierbei wird zwischen einer Näherung und drei Details (hori-zontal, vertikal und diagonal) unterschieden. Dabei ist eine gute Quantisierungsmatrixnötig. Diese wiederum basiert auf Reizschwellen (visibility or detection thresholds TL,0)für DWT-Koeffizienten in unterschiedlichen Teilbändern und Stufen der Spaltung. Dieeinfachsten Reizschwellen ohne Berücksichtigung anderer Eigenschaften des HVS kön-nen wie folgt ausgedrückt werden

log TL,O = log Tmin +K(log fL − log fOgO)2, (2.2)

wobei L die Spaltungsstufe, O die Orientierung (1,2,3,4 für Näherung, horizontale, dia-gonale und vertikale Details), Tmin die minimale Schwelle an der Ortsfrequenz gOfOund fL die Ortsfrequenz der Stufe L kennzeichnen und gO die minimale Schwelle umeine Menge verschiebt, die eine Funktion der Orientierung bildet. Auch hier kann dasModell durch Integrieren weiterer Faktoren verfeinert werden.Eine weitere Klasse von Modellen beruft sich auf den Aufbau des menschlichen Augesbeziehungsweise speziell auf die „Region of Interest“ (ROI, dt. Interessenbereich). Dieungleichmäßig auf der Retina verteilten Fotorezeptoren bestimmen die Ortsauflösung

8

der menschlichen Wahrnehmung (vergleiche auch Abschnitt 2.1.1). Der Fixationspunktist das Zentrum der ROI. Die Kontrastsensibilität nimmt von diesem Punkt aus nachaußen rapide ab. Aus dieser Beziehung (Kontrastsensibilität als Funktion der Distanzzum Fixationspunkt (Exzentrizität)) wurde experimentell eine Kontrastschwelle (con-trast threshold, CT) hergeleitet

CT (f, e) = CT0 exp

(

γ · fe+ e2

e2

)

, (2.3)

wobei f die Ortsfrequenz, CT0 die minimale Kontrastschwelle, e2 die halb-auflösendeExzentrizitätskonstante, γ die Konstante und e die Netzhautexzentrizität angibt. Die

Netzhautexzentrizität ergibt sich aus e(ϑ, x) = tan−1(

d(x)Nϑ

)

, wobei d(x) die Distanz

zwischen Mittelpunkt der ROI und der aktuellen Bildposition, N die horizontale Bild-größe und ϑ der Betrachtungsabstand gemessen in Bildbreiten ist. Berücksichtigt manzudem die Grenzfrequenz fm(x), kann dieses Modell weiter optimiert werden.Auch Kombinationen der genannten Entwürfe sind möglich. Zum einen können dieKontrastschwellen des auf ROI basierenden Designs als Gewichtungen für JND (DCT-Modelle) genutzt werden, um durch den zusätzlichen Einfluss der ungleichmäßigenVerteilung der Fotorezeptoren auf der Retina ein genaueres HVS-Modell zu generieren,welche sich auch wieder durch Einbeziehen weiterer Faktoren erweitern lassen. Analogdazu lässt sich zum anderen auch ein ROI-Modell als Gewichtung im DWT-Modell(Gleichung (2.2)) einsetzen. Allerdings muss es dazu zunächst in den DWT-Bereichtransformiert werden, was durch äquivalente Umwandlung erfolgt. Dazu wird in jedemTeilband eine äquivalente ROI und Distanz zwischen der aktuellen Position und demMittelpunkt gesucht.Zusammenfassend kann festgehalten werden, dass HVS-Modelle wahrnehmungsrele-vante Komponenten herausfiltern. Sie werden unter anderem dazu genutzt, wichtige Ei-genschaften der menschlichen Wahrnehmung in digitalen Halbtonverfahren (Abschnitt2.3) und bei der computergestützten Bewertung der Bildqualität (Abschnitt 2.2) zu be-rücksichtigen. Diese beiden, im Rahmen dieser Arbeit, sehr wichtigen Themen werdennachfolgend dargelegt.

2.2. Bewertung der Bildqualität

Abbildung 2.5.: Klassifikation der objektiven IQA-Methoden.

9

Abbildung 2.6.: Zwei verschiedene Ansätze zur objektiven Bildbewertung mit einervorhandenen Gesamtreferenz und einige Beispielmethoden.

Die Bildqualität wird gewöhnlich individuell von unterschiedlichen Personen auchunterschiedlich bewertet. Um verschiedene Verfahren zur Verbesserung der Bildquali-tät, wie beispielsweise die Digitalen Halbtonverfahren (Abschnitt 2.3), zu beurteilen,gibt es grundsätzlich zwei Möglichkeiten: die subjektive und die objektive Bewertung.Die subjektive Bewertung ist die exaktere Methode, da hier Probanden die Bilderdirekt bewerten. Ein solcher Probandentest ist jedoch sowohl zeitaufwändig als auchkostspielig. Zudem muss eine große Anzahl unterschiedlicher Probanden miteinbezo-gen werden, damit die Auswertung aussagekräftig wird. Demgegenüber stehen objekti-ve computergestützte Bewertungsmethoden. Sie prognostizieren die wahrgenommeneBildqualität. Obwohl diese nicht unbedingt mit der von Menschen wahrgenommenQualität übereinstimmt, ist diese Art der Bildbeurteilung stark verbreitet und allge-mein anerkannt.Die Klassifikation der Methoden zur objektiven Bildqualitätsanalyse (aus dem engli-schen „Image Quality Assessment“ oder kurz IQA) erfolgt anhand der Art der Referenz.Das bedeutet, dass ein Referenzbild entweder komplett („Full Reference (FR)“), teil-weise („Reduced Reference (RR)“) oder gar nicht („No Reference (NR)“) vorhanden ist.In dieser Arbeit sind die Referenzbilder vollständig verfügbar, weshalb man sich hierauf Full-Reference-IQA-Methoden beschränkt. Eine kleine Übersicht ist in Abbildung2.5 festgehalten 1. Farblich gleich hinterlegte Methoden beruhen dabei auf der gleichenGrundidee, wobei gräulich hinterlegte Methoden wiederum als unabhängig voneinan-der betrachtet werden.Wie in Artikel [HB12] beschrieben, ignorieren die meisten dieser Verfahren die Farbin-formation und beurteilen lediglich die Luminanz oder das zugehörige Graustufenbild.Da das menschliche Auge jedoch mehr Farben als Graustufen auflösen kann (Abschnitt2.1), folgt daraus auch ein gewisser Informationsverlust und damit verliert wiederumdas Ergebnis der Bewertung an Genauigkeit.Objektive IQA-Methoden werden häufig in zwei [Axe03], [Man+09] beziehungsweise

1Quellenangaben zur jeweiligen Methode sind im Anhang zu finden

10

manchmal auch drei [TD11] Kategorien unterteilt. Dies sind zum einen die mathema-tisch/statistischen oder technischen Ansätze und zum anderen die auf dem menschli-chen Wahrnehmungssystem basierenden („psychophysischen“) Ansätze. Des Weiterenwerden in [TD11] noch die auf Kantenähnlichkeit beruhenden Ansätze erwähnt, wel-che jedoch teilweise unvereinbar mit dem HVS sind. Die mathematisch/statistischenoder technischen Ansätze sind normalerweise relativ rechenunaufwändig und unab-hängig von Sichtbedingungen. Zu ihnen gehören beispielsweise MSE („Mean SquareError“, Auswerten des gemittelten quadratischen Fehlers zwischen Bilddaten) und PS-NR („Peak Signal to Noise Ratio“, Verhältnis der maximal möglichen Energie deseigentlichen Signals zur Energie des Störsignals). Die auf dem menschlichen Wahr-nehmungssystem basierenden („psychophysischen“) Ansätze berücksichtigen im Opti-malfall Struktur-, Luminanz-, Kanten- und Farbähnlichkeiten. Das Einbeziehen dieserFaktoren kann durch ein gutes HVS-Modell gewährleistet werden. Da bisher jedochkein HVS-Modell an die tatsächliche menschliche Wahrnehmung heranreicht, sind al-le Methoden von der Art der Bildverzerrung abhängig, was sich wiederum nach demangewandten HVS-Modell richtet. MSSIM („Multi-scale Structural SIMilarity index“)scheitert zum Beispiel an sehr unscharfen Bildern. Nichtsdestotrotz gilt, je ausgereif-ter das System, desto besser aber auch rechenintensiver wird es. Eine kleine Übersichteiniger Verfahren mit der Kategorieeinteilung nach [Man+09] ist in Abbildung 2.6 dar-gestellt.In vielen Arbeiten wurden bereits verschiedene IQA-Verfahren miteinander verglichen[TD11] [SSB06]. Dabei stellte sich heraus, dass CMSSIM (MSSIM mit zusätzlichemEinfluss der Farbinformation [HB12]) bisher den anderen Methoden überlegen ist -dicht gefolgt von einem Verfahren namens VIF („Visual Information Fidelity“), wel-ches in dieser Arbeit aufgrund der öffentlich zugänglichen Implementierung zur Aus-wertung der Daten im Hauptteil (3.4) verwendet wird. Im Folgenden soll auf diesesnäher eingegangen werden.

2.2.1. Visual Information Fidelity

Abbildung 2.7.: Arbeitsweise der VIF-Methode [SB06].

Visual Information Fidelity (VIF, dt. „visuelle Informationsgenauigkeit“) ist einestatistische Methode zur Bewertung der Bildqualität. Sie basiert auf Natural SceneStatistics (NSS), was einfach ausgedrückt bedeutet, dass die statistischen Eigenschaf-ten von Konturen natürlicher Bilder untersucht werden. Dies geht auf die Fähigkeit

11

Abbildung 2.8.: Testbild „Goldhill“. Von links oben im Uhrzeigersinn: Referenzbild:V IF = 1, 0, kontrastverbessert: V IF = 1, 1 , JPEG-komprimiert:V IF = 0, 1, unscharf: V IF = 0, 07 [SB12].

des menschlichen Gehirns zurück, lokale Konturen korrekt mit globalen zu verbindenund so jedes wahrgenommene Bild korrekt zu interpretieren [Gei+01]. Die grundle-gende Annahme beim VIF-Verfahren ist, dass die von Referenz- und Testbild geteilteInformation mit der wahrgenommenen Qualität in einer engen Beziehung steht.Eine stark vereinfachte Gleichung zur Bestimmung der VIF ist durch

V IF =I (C;F )

I (C;E)(2.4)

gegeben, wobei I (C;E) und I (C;F ) die idealerweise vom menschlichen Gehirn er-fassten Informationen aus Referenz- beziehungsweise Testbild darstellen. Die aus demReferenzbild mithilfe der NSS gewonnenen statistischen Eigenschaften C durchlaufenim nächsten Schritt das HVS-Modell. Dadurch gewinnt man die für die Verarbeitungim Gehirn relevanten statistischen Eigenschaften E. Demgegenüber steht das Testbild,welches zusätzlich noch einen Verzerrkanal passiert, bevor es das HVS-Modell durch-

12

läuft. Damit enthält F die für die Verarbeitung im Gehirn relevanten Informationen(Bildeigenschaften) des Testbildes (vergleiche auch Abbildung 2.7). Das Verhältnis desInformationsgehalts des Referenzbildes zu dem des Testbildes ist ein Maß (VIF-Index)für die Qualität des Testbildes im Vergleich zum Original.Bei der Anwendung von VIF erhält man meist Werte im Bereich [0, 1], wobei ein Wertvon 1.0 angibt, dass zwei Bilder identischen Informationsgehalt aufweisen. Allerdingskönnen beispielsweise durch Kontrastverschärfung auch Werte größer 1 auftreten, wel-che dann eine Verbesserung der Bildqualität gegenüber dem Referenzbild aufzeigen(vergleiche Abbildung 2.8).Dieses einfache Verfahren ist mit wenigen Annahmen systematisch herleitbar und den-noch den meisten anderen IQA-Verfahren überlegen. Nichtsdestotrotz kann es bei-spielsweise durch Berücksichtigung von Farbstatistiken weiter optimiert werden. Diegenaue mathematische Darstellung des VIF-Verfahrens sowie weitere interessante Aspek-te wie der detailreiche Vergleich mit anderen HVS-gestützten IQA-Methoden sind in[SB06] und [ACBV05] nachzulesen.

2.3. Digitale Halbtonverfahren

Abbildung 2.9.: Beispiel für ein digitales Halbtonverfahren mit AM [LA08].

Digitale Halbtonverfahren („digital halftoning“) werden dazu eingesetzt, Bilder mitbeliebig hoher Farbauflösung auf Geräten mit begrenzter Farbwiedergabe zu repro-

13

Abbildung 2.10.: Einteilung digitaler Halbtonverfahren in die drei Kategorien und je-weils einige Beispiele dazu.

duzieren. Hierbei wird ausgenutzt, dass das Auge sehr kleine Farbpunkte nicht mehreinzeln wahrnimmt sondern diese mit ihrer Umgebung (dem Hintergrund oder auchNachbarpunkten) zu Zwischenstufen integriert (vergleiche Abbildung 2.3). Die wahr-genommene Durchschnittsfarbe eines Bereichs im Halbtonbild sollte dabei der im Ori-ginalbild entsprechen [Baq+05] [Axe03] [Gn03]. Ziel ist eine optimale visuelle Qualitätfür das erzeugte Halbtonbild (im Vergleich zum Original) zu erreichen. Dies erfolgtmeist durch die Minimierung der visuellen Differenz zwischen Original- und Halbton-bild. Ursprünglich wurden digitale Halbtonverfahren entwickelt, um die Qualität vonDruckausgaben zu erhöhen. Dabei wurde zu Beginn nur mit einer Farbe (schwarz)auf einem meist weißen Substrat gearbeitet. Da jeder Graustufenwert im Original-bild normalerweise in acht Bit beziehungsweise einem Byte abgespeichert wird, solltendemnach 256 Grauabstufungen bei einem Graustufenbild mit lediglich zwei Farben(schwarz und weiß) erzeugt werden. Bei einem digitalen Farbbild wird die Farbe jedesPunktes durch drei Primärfarben rot (R), grün (G) und blau (B) repräsentiert, was zu

14

2563 (ca. 16 Millionen) darstellbaren Farben führt. Heutzutage arbeiten Drucker meistmit vier Farben - cyan (C), magenta (M), yellow (Y) und black (K) - um diese Mengean Farben darzustellen. Displays hingegen nutzen meist RGB-Pixel. Generell sind di-gitale Halbtonverfahren als Transformation eines digitalen Originalbildes in ein zwei-oder mehrstufiges Halbtonbild („bi-level oder multi-level Halftone“) definiert. Erforschtsind vor allem Techniken, die zweistufige Halbtonbilder, auch Binärbilder genannt, pro-duzieren.Bei digitalen Halbtonverfahren für Farbbilder gibt es prinzipiell zwei Möglichkeiten.Entweder werden sie auf jeden Farbkanal unabhängig oder für die drei RGB-Kanälein Abhängigkeit voneinander angewandt. Bei Ersterem kann eine homogene Punkt-verteilung für jeden Farbkanal einzeln garantiert werden, aber beim Zusammenführender drei Kanäle ist diese Homogenität nicht mehr gesichert. Somit kann es zu Farbar-tefakten und einer schlechten Farbwiedergabe kommen. Ursache dafür ist, dass einerder wichtigsten Aspekte der menschlichen Wahrnehmung und somit der menschlichenBeurteilung von Bildqualität, nämlich die Beziehung zwischen den Farben, nicht be-rücksichtigt wird. Betrachtet man dazu das HVS speziell für Farben erkennt man, dassFarbunterscheidung und -erscheinung stark mit dem räumlichen Muster und globalenUnterschieden in Farbton, Sättigung und Helligkeit zusammenhängen. Ein Gebrauchvon HVS-Modellen für die Entwicklung und Bewertung (vergleiche auch Abschnitt 2.2)von digitalen Halbtonverfahren erscheint demnach sinnvoll. Beispielsweise sind Lumi-nanzfehler bei kleineren Ortsfrequenzen gravierender als Farbfehler. Zudem wird aus-genutzt, dass das Auge Eigenschaften eines Tiefpassfilters aufweist. Das heißt, Bildrau-schen („noise“) wird meist in höhere Frequenzen verschoben, wo es als weniger störendempfunden wird. Rauschen in hohen Frequenzen bezeichnet man als „blue noise“, inmittleren Frequenzen als „green noise“.Grundsätzlich wird bei digitalen Halbtonverfahren zwischen „Amplitude Modulation“(AM, dt. Amplitudenmodulation), auch „periodic“ oder „clustered-dot“ (dt. „dicht zu-sammengedrängte Punkte“) Halftoning genannt, und „Frequency Modulation“ (FM, dt.Frequenzmodulation) oder „dispersed-dot“ (dt. „zerstreute Punkte“) Halftoning unter-schieden [LA08]. Wenn sich bei gleicher Frequenz die Größe des Punktes ändert sprichtman von AM. Falls dagegen die Größe des Punktes konstant bleibt während sich dieFrequenz ändert, ist die Rede von FM. Ein bestimmter Bereich im Halbtonbild kannbeispielsweise aus einer Halbtonzelle mit einer bestimmten Anzahl an Mikropunkten(zum Beispiel 64) bestehen. Um eine dunklere Graustufe darzustellen, kann also ent-weder ein Punkt vergrößert (AM) oder die Anzahl der Mikropunkte (Frequenz, FM)erhöht werden. Bei einer Zerstreuung der 20 Mikropunkte, aus denen der schwarzePunkt in der Halbtonzelle („Halftoned Sub-Block“) in Abbildung 2.9 besteht, würdeman von FM sprechen. Die Verteilung der Mikropunkte bei FM führt bei Druckern,die nicht fähig sind gleichmäßig kleine Mikropunkte zu produzieren, häufiger zu Bild-fehlern, weshalb die Nutzung von AM in diesem Fall von Vorteil ist. Verantwortlichfür die Bildfehler ist „dot-gain“ (gedruckter Punkt erscheint größer als im Binärbild),was sowohl physikalische (z.b. ink spread) als auch optische Ursachen (Streuung vonLicht auf Papier) haben kann. AM ist von Vorteil in Bereichen, in denen die Farbtönelangsam variieren, während FM Details besser wiedergibt. Möglich sind demnach auchVerfahren, welche beide Methoden je nach Bildbereich berücksichtigen, sogenannte

15

„AM-FM-Hybride“. Eine Methode, die als AM-FM-Hybrid angesehen wird, ist bei-spielsweise unter dem Namen „Hybrid Error Diffusion“ bekannt. Ein typisches Beispielfür eine AM- oder FM-Methode lässt sich so einfach nicht nennen, da für gewöhnlichbeides angewandt werden kann. Klassischerweise sind jedoch Punkt-Algorithmen, wieOrdered Dither nach Bayer, eher der Kategorie AM und Nachbarschafts-Algorithmen,wie Error Diffusion, eher der Kategorie FM zuzuordnen. Allerdings hat sich über dieJahre eine deutliche Tendenz zur Erforschung der FM-Methoden entwickelt. Dies liegtdaran, dass sich Mikropunkte beim Druck heutzutage genauer und gleichmäßiger set-zen lassen und so Artefakte, wie sie durch dot gain entstehen können, nicht mehr sooft wahrnehmbar auftreten [LTH06] [Lee08].Eine weitere Unterscheidung digitaler Halbtonverfahren erfolgt durch die Klassifikati-on in verschiedene Algorithmen. Meist unterscheidet man zwischen den sogenanntenPunkt-Algorithmen („point algorithm“) wie Screening oder Dithering, den Nachbarschafts-Algorithmen („neighbourhood algorithm“) wie Error Diffusion und den iterativen Algo-rithmen („iterative algorithm“) wie Direct Binary Search (DBS) [PAN03]. Eine Über-sicht findet sich in Abbildung 2.10. In der Abbildung beruhen farblich identisch hin-terlegte Verfahren auf der gleichen Grundidee, wobei gräulich hinterlegte Methodenwiederum als unabhängig voneinander betrachtet werden. Auf die Unterschiede zwi-schen den Klassen soll im Folgenden kurz eingegangen werden.Punkt- (engl. „point algorithm“), threshold-based- oder auch Class-I-Algorithmen ar-beiten mit sogenannten „Thresholdarrays“. Diese werden auf jeden Farbkanal einesBildes, im einfachen Fall unabhängig voneinander, angewandt. Die so generierten Halb-tonbilder der einzelnen Farben werden dann anschließend überlagert. Zur Erstellungeines Halbtonbildes wird der Wert eines Bildpunktes mit einem Wert im Thresholdar-ray verglichen und in Abhängigkeit des Ergebnisses ein neuer Wert an der entspre-chenden Stelle im Halbtonbild gesetzt. Da meist von 256 Abstufungen ausgegangenwird, wurde der Wert im Originalbild ursprünglich einfach mit einer festen Zahl (zumBeispiel 128) verglichen. Je nachdem ob der Bildwert nun größer oder kleiner als dieseZahl ist, wurde an der entsprechenden Position im Halbtonbild eine 0 (weiß) oder eine1 (schwarz) gespeichert. Diese einfache Methode führte zu keinem zufriedenstellendemErgebnis. Infolgedessen wurden Arrays mit mehreren unterschiedlichen Werten entwi-ckelt. Das bisher beste Kriterium, um ein solches Array zu bilden, wurde von Bayer[Bay73] vorgestellt. Daraus erhielt man weitaus bessere Resultate (vergleiche Abbilung2.11). Punkt-Algorithmen sind relativ einfach und rechenunaufwändig. Zudem ist eineParallelverarbeitung möglich, da nur ein Vergleich notwendig ist. Die Tonwiedergabeist an sich gut, allerdings sind sichtbare Muster beziehungsweise Strukurartefakte zuerkennen. Weiterhin hervorzuheben ist, dass nur wenig Zwischenspeicher erforderlichist, da nur auf dem aktuellen Bildpunkt ohne Berücksichtigung der Nachbarpunktegearbeitet wird.Nachbarschafts- (engl. „neighbourhood algorithm“), error-diffusion-based- oder auchClass-II-Algorithmen arbeiten ähnlich wie die zuvor präsentierten Punkt-Algorithmen,verteilen jedoch zusätzlich den durch Halftoning verursachten Fehler auf Nachbarpunk-te. Da die Bilddaten meist von links nach rechts und von oben nach unten verarbeitetwerden, entstehen dabei meist sogenannte „Worm Patterns“. Um diese zu vermeiden,wurden zahlreiche andere Möglichkeiten zum Durchlauf der Bilddaten (z.B. in Ser-

16

Abbildung 2.11.: Von links oben im Uhrzeigersinn: Ausgabe beim Vergleich der Bild-werte mit einem festen Threshold, mithilfe einer Bayer-Matrix, durchFloyd-Steinberg Error Diffusion und durch Structure-aware Dithe-ring [Lue11].

pentinen) vorgestellt, jedoch erhöhen diese die Komplexität des Algorithmus erheblichund weisen nur mäßigen Erfolg auf. Die Nachbarschafts-Algorithmen sind durch dieBerücksichtigung der Nachbarpunkte komplexer und speicher- sowie rechenintensiverals Punkt-Algorithmen, weisen aber meist eine bessere Bildqualität auf.Zuletzt sind noch die iterativen, iteration-based- oder auch Class-III-Algorithmen zuerwähnen. Ihre Besonderheit liegt darin, dass sie ein Bild mehrmals durchlaufen, umeine bestimmte Fehlermetrik zu minimieren oder bestimmte Bedingungen zu erfüllen.Erst dann stoppt der Algorithmus. Es gibt dabei verschiedene Ansätze für ein initialesHalbtonbild. Zum Beispiel kann ein initiales Halbtonbild einfach aus zufälligen Wer-ten bestehen. Dann wird jeder einzelne Halbtonpunkt sequentiell abgegangen und dasHalbtonbild geändert, bis die Fehlermetrik auf ein lokales Minimum reduziert ist oderbestimmte Bedingungen erfüllt sind. Durch die so erzielte homogenere Verteilung derPunkte werden ungewollte Strukturen und Muster vermieden und man erhält eine denbeiden vorangehenden Algorithmen überlegene visuelle Qualität. Iterative Algorith-men sind jedoch auch wesentlich rechenintensiver, komplexer und speicheraufwändi-ger. Die häufig notwendige Echzeitfähigkeit (beispielsweise bei der Anwendung auf 60Bilder pro Sekunde für Videos) wäre also nur mit hohem Hardwareaufwand zu reali-sieren. Ein weiteres Problem stellt die Herleitung von Fehlermetriken beziehungsweiseder zu erfüllenden Bedingungen dar, da gut abzuwägen ist, welche Kriterien im Modellerfasst werden sollten, ohne es zu überladen.Momentan werden vor allem die Nachbarschafts-Algorithmen genutzt und erforscht,da sie einen Kompromiss zwischen Komplexität, Speicherbedarf und wahrgenommenerBildqualität darstellen. In Abschnitt 3.3 werden einige Algorithmen der vorangehendenKlassen verwendet und genauer dargestellt.

17

2.4. AMOLED-Displays

(a) (b)

Abbildung 2.12.: (a) genereller Aufbau einer OLED und (b) Aufbau einer Aktivmatrix-OLED [Fre].

OLED-Displays (organische Leuchtdioden-Displays, engl. organic light-emitting diodedisplays) heben sich in vielen Punkten von den bisher verwendeten LCDs ab. Sie benö-tigen verglichen mit LCDs beispielsweise keine Hintergrundbeleuchtung, da sie selbst-leuchtend sind. Weitere Vorteile sind der geringere Strombedarf bei dunkleren Bildern,sehr viel kürzere Schaltzeiten und höherer Kontrast ohne Einschränkung des Blickwin-kels. Zudem sind OLEDs sehr dünn und können so auf flexiblem Substrat gefertigtwerden. Erwähnenswert ist auch, dass sie in einem größeren Temperaturbereich (ins-besondere auch bei Minusgraden) arbeiten [Mie]. Allerdings sind auch einige Problemebekannt, an deren Behebung derzeit geforscht wird. Zum einen sind die Emitterma-terialien sehr empfindlich, weshalb die Verkapselung der Bauelemente und der Schutzvor äußeren Einflüssen (Feuchtigkeit und Sauerstoff) sehr wichtig ist. Zum anderen istdie mittlere Lebensdauer für unterschiedliche Farben stark verschieden2 und nimmtmit größer werdender Helligkeit ab3. Zusätzlich verringert sich die Lebensdauer mithöherer Temperatur. Da die Lebensdauer für rot, grün und blau unterschiedlich ist,setzt man teilweise weiße OLEDs mit Farbfilter ein. Die Effizienz hierbei ist allerdingssehr niedrig.Der Aufbau einer OLED ist gegeben durch eine oder mehrere organische Schichten4

2 Die „T50 lifetime“ (mittlere Lebensdauer nach der nur noch die Hälfte der Leuchtdichte erreichtwird) beträgt für rote P-OLEDs (Polymer-OLEDs) ca. 200.000 h, für grüne P-OLEDs ca. 296.000 hund für blaue P-OLEDs ca. 20.000 h [Rob+12].

3Als generelle Faustregel gilt, dass sich die Lebensdauer verdoppelt, wenn die Helligkeit halbiert wird[CAW07].

4In der Regel werden als organische Materialien entweder langkettige Polymere oder kleine Moleküle(engl. small molecules) eingesetzt.

18

Abbildung 2.13.: 2T1C-Pixelschaltung für ein AMOLED-Display [Vol13].

zwischen zwei Elektroden, vergleiche Abbildung 2.12. Durch Anlegen einer Spannungwerden Ladungsträger aus beiden Elektroden in die organische Schicht injiziert. Dortbilden sie angeregte Zustände (es entstehen Elektron-Loch-Paare, sogenannte Exzito-nen). Beim Zerfall des Exzitons wird schließlich Licht emittiert.Aktivmatrix-OLED-Displays (vergleiche auch Abbildung 2.12 ) (AMOLED-Displays,engl. active-matrix organic light-emitting diode displays) sind Displays, bei denen jedereinzelne Subpixel über eine eigene aktive Beschaltung gesteuert wird. Sie stehen imKontrast zu Passivmatrix-OLED-Displays (PMOLED-Displays, engl. passive-matrixorganic light-emitting diode displays), deren OLEDs in den Schnittpunkten zweier sichüberkreuzender Elektrodenstreifen liegen und ohne aktive Pixelschaltung auskommen.Die Helligkeit der OLEDs wird wie auch bei AMOLEDs vom eingespeisten Strom be-stimmt. PMOLED-Displays sind wegen der sequentiellen Ansteuerung der Pixel ohneSpeichereinheit (Pixel leuchtet nur während der „Programmierung“) in der Größe be-schränkt.Die aktive Beschaltung der AMOLEDs dient dagegen sowohl als Speichereinheit als

auch als Treiber zur Helligkeitssteuerung. Durch sie ist es möglich, die Pixelhelligkeitzwischen zwei Programmiervorgängen zwischenzuspeichern. Die einfachste schaltungs-technische Realisierung ist durch eine 2T1C-Pixelschaltung (wie in Abbildung 2.13) gegeben. 2T steht hierbei für die zwei Transistoren, genauer TFTs (Dünnschicht-transistor, engl. thin-film transistor) und mit 1C ist der Kondensator gemeint. DerSwitch-Transistor T1 wird durch Anlegen einer Spannung auf der Select-Leitung ge-steuert und agiert hier als Schalter. Solange der Schalter offen ist, wird das Gate desDrive-Transistor über den Spannungswert auf der Datenleitung programmiert und zu-gleich der Spannungswert in der Storagekapazität gespeichert. Die Ansteuerung mitden beiden Transistoren als Schalter und der Steuerung der wahrgenommenen Hellig-keit durch die Zeit, in welcher die OLED leuchtet (vergleiche Pulsweitenmodulation),wird als digitale Ansteuerung bezeichnet. Die Anzeige von Bildern erfordert regulär 26

bis 28 Helligkeitsabstufungen (sechs bis acht Bit) je Farbe. Eine solche Auflösung wirdrealisiert, indem einzelne Frames in eine bestimmte Anzahl an Subframes gespalten

19

Abbildung 2.14.: Aufteilung, Gewichtung und Aufsummierung der Subframes einesBildes.

werden. Die Mindestanzahl an Subframes muss wenigsten der Anzahl der Helligkeits-stufen in Bit entsprechen, ist meistens jedoch noch höher, da Kompensationen wieGammakorrektur integriert werden müssen. Es erfolgt eine Gewichtung der einzelnenSubframes durch die Leuchtdauer t

ti = 2(x− i) · tx, i = 0, ..., x, (2.5)

wobei tx die kürzeste vorgesehene Leuchtdauer, i die Nummer des Subframes und x

die maximale Anzahl an Subframes kennzeichnet [Vol13]. Das digitale Treiben basiertdemnach auf der Aufteilung des Originalbildes in einzelne Subframes, welche nachdemsie mit der vorgesehenen Leuchtdauer gewichtet worden sind, wieder aufsummiert wer-den, vergleiche Abbildung 2.14. In der Realität weist das Auge ein Tiefpassverhaltenund übernimmt damit die notwendige Integration über die Leuchtdichte. Bei der ana-logen Ansteuerung agiert der Drive-Transistor als gesteuerte Stromquelle, mit der auchdie Helligkeit variiert wird. Für den Drain-Source-Strom IDS gilt im Sättigungsbereich,unter Vernachlässigung von Kurzkanal- und anderen parasitären Effekten

IDS =KP

2· (UGS − Uth)

2, (2.6)

wobei KP den Verstärkungsfaktor des Drive-Transistors, Uth seine Schwellspannungund UGS die Gate-Source-Spannung darstellt. Wie in Gleichung 2.6 ersichtlich, hängtder Strom (quadratisch) von der Schwellspannung ab, welche wiederum stark von Fer-tigungsschwankungen und Alter der Transistoren beeinflusst wird. Das digitale Trei-berschema nutzt den linearen Bereich, wodurch die Schwellspannung nur einen gemin-derten (linearen) Einfluss auf den Strom nimmt.In Kooperation mit der Firma Visionox wurde ein bereits vorhandenes Displaydesignso angepasst, dass es digital angesteuert werden kann. Dazu war insbesondere einehöhere Programmiergeschwindigkeit erforderlich, die auch erreicht werden konnte.

20

Nichtdestotrotz sind zur Optimierung des Displays noch einige weitere Tests not-wendig.Das Display hat eine Auflösung von 320 × 240 Pixeln (beziehungsweise 3 · 240 = 720Subpixeln pro Spalte) und eine Diagonale von 2,8”. Im Display sind RGB-OLEDs mitFarbfiltern eingebaut. Es arbeitet mit der erforderlichen 2T1C-Pixelschaltung, wurdeaber für die analoge Ansteuerung entworfen. Mithilfe eines 1:3 Demultiplexers werdenje Spalte die drei Farben (RGB) seriell programmiert. Bei jedem Programmiervorgangwerden dabei 240 Subpixel einer Farbe parallel beschrieben. Die parallele Programmie-rung ermöglicht eine höhere Bildwiederholrate bei hoher Anzahl an Subframes, wobeisich eine Bildwiederholrate von 120 Hz5 bei 10 Subframes (also 1200 Subframes proSekunde) als geeignet erwies.Im Rahmen dieser Arbeit sollen die Eigenschaften dieses Displays simuliert werden,um zu untersuchen, welches digitale Halbtonverfahren sich für ein AMOLED-Displayam geeignetsten erweist, um den wahrgenommenen Farbraum bei einer festen Zahl anSubframes zu erweitern.

2.5. Gammakorrektur

Abbildung 2.15.: Prinzip der Gammakorrektur [MJB05].

Je nachdem, mit welchem Gerät ein Bild aufgenommen oder dargestellt wird, sindzum Teil deutliche Abweichungen in Farbton, Helligkeit, Konturen etc. zu sehen. Aufdieses Phänomen trifft man beispielsweise des Öfteren beim Wechsel auf einen ande-ren Monitor. Gründe hierfür sind die zum Teil abweichenden Systemeinstellungen derAufnahme- und Ausgabegeräte (z.B. durch verschiedene Hersteller) sowie Diskrepan-zen bei der menschlichen Wahrnehmung. Mithilfe eines Gammawerts werden die Datenfür ein Anzeigegerät an die Empfindlichkeit des menschlichen Auges angepasst, ver-gleiche auch Abbildung 2.15. Ein Gerät mit Gammawert γc nimmt ein Signal auf. Aufdas erzeugte Ausgangssignal s wird eine Gammakorrektur mit γ̄c =

1γc

angewendet. bstellt das zur Lichtintensität B proportionale korrigierte Signal dar.Der Gammawert des menschlichen Auges ist der „Stevensschen Potenzfunktion“ zu-folge ca. 0,3 bis 0,5 [Win]. Die digitalen Bilddaten liegen häufig in linearer Form vor.

5Damit vom menschlichen Auge kein Flackern wahrgenommen wird, sind mindestens 60 Hz notwen-dig.

21

Damit der (menschliche) Betrachter das Bild wiederum linear wahrnimmt, muss dasBildsignal vorher mithilfe eines reziproken Gammawerts vorprozessiert werden. DieserFaktor ist für die meisten Monitore auf 2,2 festgelegt.In Abbildung 2.16 sind Verläufe von Gammafunktionen für verschiedene Gammawerte

Abbildung 2.16.: Gammafunktion für verschiedene Gammawerte [MJB05]

dargstellt. Der Wert b ergibt sich hier nach folgender Gleichung

b = fγ(a) = aγ . (2.7)

Durch eine Gammakorrektur sollen also Abweichungen kompensiert und die Bilder aufeinen gemeinsamen Intensitätsraum abgestimmt werden. Die Gammafunktion (verglei-che auch Abbildung 2.16) mit a ∈ R, γ > 0, bildet die Grundlage einer Gammakorrek-tur [MJB05]. Sie gibt entsprechend den Eingangsdaten a Ausgangsdaten b zurück. DieGammafunktion hat den Vorteil, dass sie im Definitionsbereich stetig, streng monotonund umkehrbar ist. Es ist üblich, mit Eingabewerten im Bereich [0, 1] zu arbeiten,sodass auch die Ausgabewerte im Intervall [0, 1] liegen. Die minimale und maximaleHelligkeit (schwarz und weiß) bleiben somit unverändert, während die dazwischenlie-genden Helligkeiten angepasst werden.Für Pixelwerte, die beispielsweise im Bereich [0, amax] liegen, ist folgende Vorgehens-weise gängig: Zunächst wird der gegebene Bereich auf einen Bereich [0, 1] skaliert.Im nächsten Schritt wird auf den skalierten Bereich die Gammafunktion angewendetund zuletzt zurück auf den Ausgangsbereich skaliert. Die (inverse) Gammakorrekturfindet später bei der Simulation des Verhaltens eines AMOLED-Displays Anwendung(vergleiche Abschnitt 3.2)

22

3. Implementierung und Validierung

digitaler Halbtonverfahren

3.1. Problemstellung

Abbildung 3.1.: Einfache Darstellung der Vorgehensweise von örtlichem Dithering.

Die begrenzte Farbtiefe von Displays (üblicherweise 8 bis 10 Bit im Consumer-Bereich) führt bei bestimmten Bildinhalten zu Artefakten, wie beispielsweise Höhenli-nien in Farbverläufen. Zudem wird dadurch die Farbdarstellung eingeschränkt. Um diewahrgenommene Farbtiefe zu erhöhen, ohne die wiedergegebene Farbtiefe zu ändern,bieten sich zwei Möglichkeiten an. Zum einen kann durch zeitliches Dithering zwei-er Farbwerte ein dazwischenliegender Farbwert simuliert werden. Dieses Verfahren istals „Frame-Rate-Control“ (kurz: FRC) bekannt. Zum anderen ist die Darstellung ei-nes Zwischenfarbwerts durch örtliches Dithering, das bedeutet die Wiedergabe diesesFarbwerts durch Ausnutzen der Integration des Auges über zwei oder mehrere benach-barte Farbwerte, möglich.Diese Integration des Auges über einen gewissen Bereich wird von allen digitalen Halb-tonverfahren ausgenutzt. So kann beispielsweise, wenn die Pixel klein genug dargestelltwerden, durch vier nebeneinander liegende unterschiedliche Werte ein Zwischenwert re-präsentiert werden. Bei dem Beispiel in Abbildung 3.1 werden so durch vier verschiede-ne Werte jeweils die Zwischenstufen 32.5 beziehungsweise 32.25 dargestellt. Allerdingskönnen bei ungünstigen Farbverläufen dadurch auch große Fehler entstehen. Ein Bei-spiel dafür wäre, wenn die Werte 0 und 255 dicht beisammen liegen. Hier würde beider Integration des Auges über vier Werte (0, 255, 0, 255) ein Zwischenwert von 127,5erzeugt werden.Im Folgenden wird zunächst dargelegt, was bei der Simulation eines Displaysystemszu berücksichtigen ist.

23

3.2. Simulation digitaler Halbtonverfahren

Abbildung 3.2.: Ablauf der Simulation.

Im Rahmen dieser Arbeit wurde mithilfe von MATLAB ein Simulator implemen-tiert, der das Verhalten des AMOLED-Displays, welches in Zusammenarbeit mit derFirma Visionox am Mikroelektronik-Lehrstuhl entwickelt wird (vergleiche Abschnitt2.4), nachstellen soll. Hierbei soll simuliert werden, wie sich verschiedene digitale Halb-tonverfahren auf die Darstellung eines Eingabebildes auswirken. Es wird hierbei voneinem fiktiven Displaysystem mit digital angesteuertem AMOLED-Display mit 5 BitFarbtiefe (5 Subframes) ausgegangen. Die Farbtiefe wurde so gering gewählt, um aufdem LCD (nur 8 Bit Farbtiefe) auftretende Fehler gut erkennen zu können (vergleicheauch Abbildung 3.2 und 3.3). Dazu wird zunächst ein Eingabebild mit einem Wertebe-reich von 0 bis 255 eingelesen, dann auf den Bereich 0 bis 1 skaliert und gegebenenfallszur schnelleren Terminierung des Algorithmus auf VGA-Auflösung verkleinert. DieSkalierung wird nach Anwendung der Gammakorrektur, welche zur Anpassung derDaten an die menschliche Wahrnehmung auch von realen Displaysytemen vorgenom-men wird, wieder erhöht und die Bilddaten werden jeweils in die fünf höchst- unddrei niedrigstwertigen Bit aufgeteilt. Danach kommt eines der zwölf implementiertendigitalen Halbtonverfahren auf die drei niedrigstwertigen Bit der Bilddaten zum Ein-satz. So erhofft man sich, die Fehler, die durch Anwendung dieses Verfahren entstehen,möglichst gering zu halten. Die dabei erhaltenen 1 Bit Daten werden ohne Überlaufwieder zu den fünf höchstwertigen Bit addiert. Anschließend werden die so gewonne-nen 5-Bit-Bilddaten in fünf einzelne Subframes aufgeteilt und es wird die Summe überalle Subframes, gewichtet mit unterschiedlicher Subframedauer, berechnet (vergleicheauch Abschnitt 2.4). Das letztlich erhaltene 5-Bit-Testbild wird gespeichert und späterauf einem LCD betrachtet, weswegen noch vor dem Speichern eine inverse Gamma-korrektur angewandt werden muss. So soll simuliert werden, wie das Bild letztendlichtatsächlich vom AMOLED-Display angezeigt wird.Zur Auswertung der Daten wird das Bildanalyseverfahren Visual Information Fidelity(vergleich Abschnitt 2.2.1) eingesetzt. Hierzu werden die durch die unterschiedlichenHalbtonverfahren erhaltenen Testbilder nacheinander mit dem Originalbild verglichenund der VIF-Wert gespeichert. Vor der Auswertung der Ergebnisse werden im Folgen-den zunächst die 12 verwendeten Halbtonverfahren kurz vorgestellt.

24

Abbildung 3.3.: Spezieller Ablauf des Halftoning in der Simulation.

3.3. Verwendete Halbtonverfahren

In Abschnitt 2.3 wurde bereits ein grober Überblick über digitale Halbtonverfahrengegeben. Diese basieren, wie bereits erwähnt, auf der örtlichen Integration des Augesund geben im Allgemeinen für 8 Bit Eingangsdaten 1 Bit Ausgabedaten zurück. Andieser Stelle sollen die 12 (siehe Tabelle 3.1) verwendeten Halbtonverfahren dargestelltwerden. Zu beachten ist, dass deren ursprüngliche Implementierung so verändert wur-de, dass bei einer Eingabe von 8 Bit Bilddaten keine Ausgabe von 1 Bit Bilddatenmehr erfolgt, sondern dass lediglich auf den drei niedrigstwertigen Bit gearbeitet wird.Das bedeutet, dass für die 3 Bit Bilddaten 1 Bit Bilddaten generiert werden, welchewieder auf die fünf höchstwertigen Bit addiert werden, sodass letztlich 5 Bit Bilddatenausgegeben werden. Manche dieser Methoden sind allerdings auf eine Verarbeitungder Daten von 8 Bit auf 1 Bit ausgelegt und daher müssen die verwendeten Matrizenangepasst werden. Dies erfolgt durch einige Anpassungen hinsichtlich der Skalierung.Wie bereits erwähnt sind iterative Methoden sehr komplex und nicht echtzeitfähig.Da keine öffentlich zugängliche Implementierung eines iterativen Algorithmus verfüg-

25

bar ist und der zu erwartende Nutzen, der aus einer eigenständige Implementierungeiner solchen Methode geschöpft werden könnte, in keinem Verhältnis zum aufgebrach-ten (Zeit-)Aufwand steht, werden in dieser Arbeit nur einige ausgewählte Punkt- undNachbarschaftsalgorithmen betrachtet. Nachfolgend werden die verwendeten Halbton-verfahren, beginnend mit Ordered Dither nach Bayer, genauer dargelegt.

3.3.1. Ordered Dither nach Bayer

Bei diesem Verfahren handelt es sich um ein threshold-basiertes Verfahren (vergleicheAbschnitt 2.3). Mithilfe einer Threshold-Matrix wird hierbei der aktuell zu bearbei-tende Pixelwert mit einem entsprechenden Wert in der Threshold-Matrix verglichenund in Abhängigkeit des Ergebnisses ein neuer Wert an der entsprechenden Stelle imHalbtonbild gesetzt. Die bei dieser Methode angewandte 8× 8 Bayer-Matrix [CBM91]lässt sich folgendermaßen darstellen

MBayer8×8=

0 32 8 40 2 34 10 4248 16 56 24 50 18 58 2612 44 4 36 14 46 6 3860 28 52 20 62 30 54 223 35 11 43 1 33 9 4151 19 59 27 49 17 57 2515 47 7 39 13 45 5 3763 31 55 23 61 29 53 21

. (3.1)

Bevor die drei niedrigstwertigen Bit der Bilddaten mit den entsprechenden Wertenin der Bayer-Matrix verglichen werden, müssen die Werte der Matrix noch auf denBereich 0 bis 7 skaliert werden. Anschließend werden die Bilddaten von links nachrechts und oben nach unten für jeden der drei Farbkanäle einzeln durchlaufen undmit einem Wert der Bayer-Matrix entsprechend MBayer(mod(i, 8) + 1,mod(j, 8) + 1)verglichen, wobei i und j die aktuelle Reihe beziehungsweise Spalte kennzeichnen.Falls der Bildwert größer als der dazugehörige Matrixwert ist, wird in einer neuenMatrix an der entsprechenden Position der Wert 1 gespeichert, sonst 0. So erhältman 1 Bit Daten, welche ohne Überlauf zu den fünf höchstwertigen Bit der Bilddatenhinzuaddiert werden.Eine zweite 6× 6 Matrix [Zer13], die auch auf dem Bayer-Kriterium beruht,

MBayer6×6=

32 16 20 34 18 2212 0 4 14 2 628 8 24 30 10 2635 19 23 33 17 2115 3 7 13 1 531 11 27 29 9 25

. (3.2)

wird ebenfalls zunächst auf den Wertebereich [0, 7] skaliert. Die Vorgehensweise erfolgtdanach analog zu oben vorgestellter.Generell wurde das von Bayer vorgestellte Optimierungskriterium [Bay73] genutzt, um

26

Matrizen zu generieren, die nur wenig Ortsfrequenzrauschen in der Bildanzeige her-vorrufen. Das bedeutet für die menschliche visuelle Wahrnehmung, dass die Matrizenkeine Strukturen bei der Anzeige von Bildern mit wenig Details und relativ konstanterHelligkeit erzeugen sollen [Lee08]. Eine rekursive Beziehung zwischen der 2× 2 Matrixvon Limb [Lim69], der erstmals Ordered Dither vorstellte, und den Bayer-Matrizenwurde in C. N. Judices’ Artikel [NFH74] vorgestellt und sieht wie folgt aus:

Dn =

(

4Dn

2 +D200U

n

2 4Dn

2 +D201U

n

2

4Dn

2 +D210U

n

2 4Dn

2 +D211U

n

2

)

, (3.3)

wobei

D2 =

(

0 23 1

)

(3.4)

und

Un =

1 1 . . . 11 1 . . . 1... 1

. . ....

1 . . . 1 1

. (3.5)

Aus dieser Beziehung kann man jegliche n×n Bayer-Matrix konstruieren. Auch sämt-liche Rotationen und Spiegelungen von Matrizen, die aus dieser Beziehung gewonnenwerden können, erfüllen das Optimierungskriterium von Bayer.Diese Methode ist wenig rechenaufwändig und erfordert auch nur wenig Speicherka-pazität. Allerdings müssen bei der visuellen Bildqualität Abstriche gemacht werden,da zum Beispiel ungewollte ausgeprägte Strukturmuster (speziell bei Bayer das soge-nannte „cross-hatch pattern“) auftreten.

3.3.2. Look-Up-Tables

Ordered Dither nach Bayer kann, wie im vorangegangenen Abschnitt gezeigt, durchviele unterschiedliche Matrizen erfolgen. Auch Look-Up-Tables lassen sich sehr viel-fältig entwickeln. In dieser Arbeit wurden fünf unterschiedliche Modelle, welche aufLook-Up-Tables (kurz: LUT) oder auch „optimierte Pattern“ genannt basieren, model-liert und in MATLAB implementiert. Dazu gehören jeweils ein „sequentielles“ und ein„zufälliges“ Pattern für je ein 3×3 und ein 2×4 Schema. Zudem wurde noch ein „schlech-tes“ Pattern erstellt, bei welchem relativ schlechte Ergebnisse erwartet werden. DiesesPattern hat den Zweck zu verdeutlichen, wie die visuelle Bildqualität durch schlechtgewählte Look-Up-Tables, merklich herabgesetzt werden kann.Bei diesem Schema wird entsprechend der drei niedrigstwertigen Bit eines Bildpunk-tes eine LUT ausgewählt. Je nachdem, welche Position des Bildes gerade bearbeitetwird, wird die zugehörige Position in der Look-Up-Table ausgelesen und der jeweiligeWert (0 oder 1) auf den aktuellen Bildwert hinzuaddiert. Bei dieser Methode kommtes demnach vor allem auf die Wahl der entsprechenden Tabelle an, welche aufgrundder aktuellen Bildposition und dem Wert der zu verarbeitenden Bit erfolgt. Es gibtfolglich für drei Bit acht verschiedene Tabellen. Pro Tabelle kommt, angefangen mit

27

einer nur aus Nullen bestehenden Tabelle, jeweils eine Eins hinzu. So wird eine gewisseFehlerdiffusion erreicht. Zufällige Look-Up-Tables zeichnen sich dadurch aus, dass dieVerteilung der Einsen einzelner Tabellen unabhängig voneinander sind. Im sequentiel-len Fall wird die schon bestehende Tabelle quasi kopiert und eine Eins an eine Stelle,an der vorher keine war, hinzugefügt. Die verwendeten Look-Up-Tables sind in Abbil-dung 3.4 dargestellt. LSBs steht für „Least Significant Bit“ (dt. niedrigstwertiges Bit).R und S ergeben sich aus

R = i mod k (3.6)

undS = j mod m, (3.7)

wobei i und j jeweils für die Zeile und Spalte der aktuell zu bearbeitenden Bildpositionund k und m entsprechend für die maximale Anzahl der Zeilen und Spalten in derTabelle stehen.Wenn der aktuelle Bildwert in Zeile 131 und Spalte 183 188 (binär: ’10111100’) ist unddie sequentiellen 2×4 LUTs genutzt werden, werden also nur die drei niedrigstwertigenBit des Wertes (’100’) betrachtet. Demnach wird in Abbildung 3.4 b) die Tabelle mitLSBS = 100 betrachtet. R und S ergeben sich zu

R = 131 mod 4 = 3 (3.8)

undS = 183 mod 2 = 1. (3.9)

An dieser Position steht in der Tabelle eine 1, welche zu den 5 höchstwertigen Bit desoriginalen Bildwerts addiert wird.Das allgemeine Prinzip beruht auf der örtlichen Integration des Auges und ist in Ab-bildung 3.1 dargestellt.Aufwand, Speicherkapazität und erhaltene visuelle Bildqualität sind ähnlich wie beiOrdered Dither nach Bayer. Auch bei den aus LUT-Modellen generierten Bildern sindungewollte Strukturmuster zu erkennen, welche im Folgenden durch das Berücksichti-gen von Nachbarpixeln, beziehungsweise das Verteilen des Fehlers auf diese, vermiedenwerden sollen.

28

(a) Zufällige 2× 4 LUTs

(b) Sequentielle 2× 4 LUTs

(c) Zufällige 3× 3 LUTs

(d) Sequentielle 3× 3 LUTs

(e) Sequentielle 3× 3 LUTs mit verbesserter Verteilung

Abbildung 3.4.: Die fünf verwendeten Look-Up-Table-Modelle.

29

3.3.3. Error Diffusion

Der Vorteil von Nachbarschaftsalgorithmen gegenüber Punktalgorithmen ist, dass durchdas Verteilen des Fehlers, eine höhere Detailgenauigkeit erreicht wird und wenigerstrukturelle Muster auftreten. Nachstehend werden einige dem Bereich Error Diffusi-on zugeordnete Nachbarschaftsalgorithmen vorgestellt.In dieser Arbeit wurden die von Floyd-Steinberg, Jarvis, Stucki und Zhou-Fang vor-gestellten Methoden implementiert und deren Resulate ausgewertet. Der wesentlicheUnterschied zwischen den unterschiedlichen Error-Diffusion-Methoden sind die jeweilsangewandten Filter. Floyd und Steinberg veröffentlichten 1976 den wohl bekanntestenFilter

1

16·

(

0 0 73 5 1

)

. (3.10)

Dieser zeichnet sich insbesondere dadurch aus, dass man die Division durch 16 auchdurch Shifts erreichen kann, was eine Hardwareimplementation erheblich vereinfacht.Kurz danach stellte Jarvis seinen Filter vor

1

48·

0 0 0 7 53 5 7 5 31 3 5 3 1

. (3.11)

Es lässt sich unschwer feststellen, dass dieser Filter den Fehler auf mehr Nachbarpixelverteilt als der vorangegangene. Ein ähnlicher Filter wurde 1982 von Stucki publiziert

1

42·

0 0 0 8 42 4 8 4 21 2 4 2 1

. (3.12)

Da alle Filter den Fehler nur vom aktuell bearbeiteten Bildpunkt auf nachfolgendeSpalten und Reihen verteilen, entstehen die schon in Abschnitt 2.3 genannten WormPatterns. Diese machen sich bei näherem Hinsehen durch wurmartige Formen im Bild,die von links oben nach rechts unten verlaufen, erkennbar (vergleiche Abbildung 3.5).Diese visuellen Artefakte bildeten die Grundlage zur Entwicklung weiterer Filter. Al-lerdings sind die Filter nach Jarvis und Stucki hardwareaufwändiger und liefern keineerheblich bessere Bildqualität. Daher wird meist der Filter nach Floyd-Steinberg ver-wendet.Ursprünglich wurde bei diesen Methoden das Bild zunächst einfach auf den Bereich[0; 1] skaliert und dann mit einem Threshold (0,5) verglichen. Je nachdem, ob der Bild-wert höher oder niedriger war, wurde dann eine 1-Bit-Matrix generiert. Der darausentstandene Fehler wurde nachfolgend berechnet und mithilfe eines beliebigen Filtersverteilt. Die Methoden mit dem Stucki- und Floyd-Steinberg-Filter wurden anfänglichlediglich zur Darstellung von Binärbildern implementiert. Das heißt, dass durch dieseMethoden die Drucker, die damals nur mit schwarzer und weißer Farbe gearbeitet ha-ben, letztendlich eine kleine Zahl verschiedener Graustufen darstellen konnten.Da es hier aber möglich ist, nicht nur binäre, sondern auch mehrstufige Bilder zu gene-rieren, wurde alternativ eine Methode implementiert, bei der zunächst eine sogenannte

30

Abbildung 3.5.: Bild mit deutlichem Auftreten von Worm Patterns [Hel12].

„Old Color Map“ (alte Farbpalette) erzeugt wird. Diese hat die Funktion, einen Vektorzu erzeugen, welcher beispielsweise 256 Werte auf 32 Werte abbildet. So ist es möglich,erheblich mehr Farbabstufungen darzustellen, den entstehenden Fehler wesentlich zuverringern und dabei noch die Bildqualität zu erhöhen.Ostromoukhov [Ost01] hatte 2001 erstmals die Idee, Diffusionskoeffizienten abhän-gig vom Graustufenwert zu verändern. Dazu wurden „schwierige“ Graustufen experi-mentell ermittelt und deren Gewichtung anhand der Optimierung eines bestimmtenKriteriums (Spektrum des Fehlerbildes möglichst im hohen Frequenzbereich) in derAusgabe eines homogenen Bildes mit diesem Grauwert gewählt. Gewichtungen ande-rer Graustufen wurden dann mittels linearer Interpolation ermittelt. Zhou und Fanghaben diesen Algorithmus dann mit „Threshold Modulation“ erweitert [ZF03]. DerThreshold einiger Schlüssel-Graustufen wurde dazu ebenfalls experimentell ermitteltund für alle anderen Graustufen linear interpoliert. Zudem erfolgt die Bearbeitung desBildes bei dieser Methode in Serpentinen [Lue11]. Da die Methode nach Zhou undFang beziehungsweise genauer deren verwendete Matrizen speziell zur Abbildung von8 Bit auf 1 Bit ausgelegt ist, wurde sie hier nur der Vollständigkeit halber betrachtet.Eine empirische Bestimmung von entsprechenden Matrizen zur Abbildung der Datenvon 3 Bit auf 1 Bit würde eventuell zu einer Verbesserung der Ergebnisse führen, wärejedoch zu aufwändig. Deren Berechnung liegt daher außerhalb des Fokus dieser Arbeit.

3.4. Ergebnisse und Auswertung

Im Rahmen dieser Arbeit wurden auf 134 verschiedene Testbilder jeweils alle 12 imvorherigen Abschnitt 3.3 implementierten digitalen Halbtonverfahren angewandt. Dieserfolgte mithilfe des im Abschnitt 3.2 vorgestellten Simulators. Die so erhaltenen Test-

31

bilder wurden dann mithilfe des Bildanalyseverfahrens VIF mit dem entsprechendenReferenzbild verglichen. Dann wurde für jedes digitale Halbtonverfahren einzeln aus-gewertet, bei welchem Testbild es den schlechtesten beziehungsweise besten VIF-Wertaufweist. Zudem wurde noch der generell beste beziehungsweise schlechteste Wert, daszugehörige Verfahren und das diesen Wert aufweisende Testbild ermittelt, vergleicheTabelle 3.1.

Verfahren VIF-Wertmin

(Bildnum-mer)

VIF-Wertmax

(Bildnum-mer)

VIF-Wertmean

8× 8 Bayer-Matrix 0,690 (100) 0,938 (158) 0,8546× 6 Bayer-Matrix 0,498 (201) 0,887 (158) 0,740Sequentielle 2× 4 LUTs 0,601 (201) 0,915 (158) 0,795Zufällige 2× 4 LUTs 0,531 (201) 0,911 (158) 0,768Sequentielle 3× 3 LUTs 0,514 (201) 0,891 (158) 0,739Sequentielle 3× 3 LUTsa 0,601 (201) 0,927 (158) 0,818Zufällige 3× 3 LUTs 0,501 (201) 0,907 (158) 0,762Jarvis 0,709 (201) 0,951 (131) 0,850Floyd-Steinbergb 0,814 (171) 0,958 (163) 0,897Floyd-Steinberg 0,813 (171) 0,958 (163) 0,898Zhou-Fang 0,478 (100) 0,962 (158) 0,749Stucki 0,735 (171) 0,956 (131) 0,863

Tabelle 3.1.: Digitale Halbtonverfahren, zugehörige Minimal-, Maximal-VIF-Werteund Durchschnitts-VIF-Werte sowie entsprechende Testbildnummer, beiwelchem diese Werte auftreten.

amit verbesserter Verteilungbmit Old Color Map

Um herauszufinden wie gut sich der VIF-Wert mit der subjektiven Wahrnehmungdeckt, wurden einige Bilder noch einmal genauer betrachtet. Dabei fällt auf, dassZhou-Fang Error Diffusion zwar teilweise gute bis sehr gute VIF-Werte aufweist, dieseaber nicht mit dem subjektiven Empfinden übereinstimmen, was wahrscheinlich anden falsch ausgelegten Matrizen liegt, vergleiche Abschnitt 3.3.3. Die meisten anderenWerte jedoch sind größtenteils damit konform. So liefert beispielsweise Floyd-SteinbergError Diffusion durchweg gute Ergebnisse, was auch aus den VIF-Werten hervorgeht.Bei einigen Testbildern kommt es vor, dass zwischen den Methoden nur wenige Unter-schiede erkennbar sind, die VIF-Werte aber stark schwanken, vergleiche zum BeispielAbbildung 3.8 und 3.9. In Abbildung 3.6 sind die Auswirkungen der verschiedenen Ver-fahren nebeneinander für eine Grauskala dargestellt. Zudem lässt sich noch festhalten,dass selbst beim niedrigsten Wert (0,48) immerhin noch gut die Hälfte der Informationvom Originalbild erhalten ist. Nichtsdestotrotz ist ersichtlich, dass Nachbarschaftsal-gorithmen im Allgemeinen bessere Werte erzielen als Punktalgorithmen. Dafür isteine höhere Speicherkapazität notwendig, da bei den Error-Diffusion-Verfahren meistmehrere Zeilen nacheinander durchlaufen und gespeichert werden müssen. Es muss ab-

32